2026년 4월 AI 모델 순위표 — Claude vs GPT vs Gemini, 누가 1위일까?

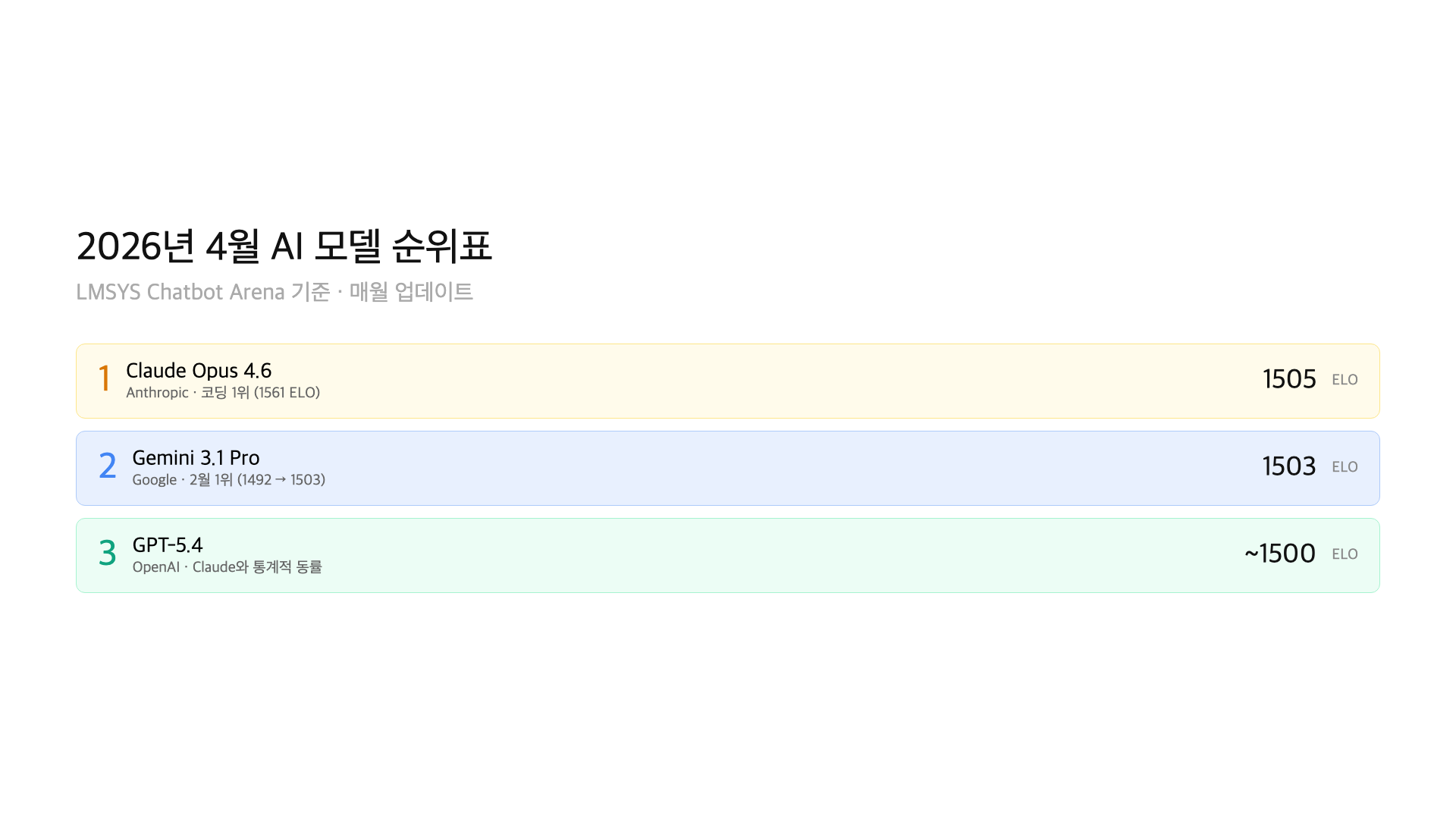

LMSYS Chatbot Arena 기준 2026년 4월 AI 모델 순위를 정리했어요. Claud

2026년 4월 4일 · AI 소식 · 매월 업데이트

“지금 가장 좋은 AI 모델이 뭐예요?” 매주 한 번은 받는 질문이에요. 그런데 답이 계속 바뀌어요. 2026년 2월에는 Gemini 3 Pro가 1위였는데, 4월에는 Claude Opus 4.6과 GPT-5.2가 통계적 동률이에요. 한 달 차이로 순위가 뒤집혀요.

그래서 매월 업데이트하는 AI 모델 순위표를 만들었어요. LMSYS Chatbot Arena 기준으로, 종합·코딩·오픈소스 카테고리별로 정리해요. 벤치마크 점수만 나열하는 게 아니라, 실제로 어떤 용도에 어떤 모델이 맞는지도 같이 알려드려요.

LMSYS Chatbot Arena는 UC Berkeley 연구팀이 운영하는 플랫폼이에요. 사용자들이 두 모델의 답변을 블라인드로 비교하고 승자를 선택해요. 이 결과를 체스 Elo 방식으로 점수화해요. 자체 벤치마크보다 실사용 선호도를 반영하기 때문에 업계에서 가장 신뢰하는 순위예요.

– 종합 1위: Claude Opus 4.6 (1505 Elo)과 GPT-5.2가 통계적 동률

– 코딩 1위: Claude Opus 4.6 (1561 Elo)

– 오픈소스: DeepSeek V4, Llama 4, Qwen 3.5가 빠르게 추격 중

– 순위는 매주 변동 — 이 글의 발행일을 확인해주세요

순위표 보는 법 — Elo 점수가 뭔가요?

Elo 점수는 체스에서 쓰던 레이팅 시스템이에요. 두 선수(모델)가 대결하면 이긴 쪽의 점수가 올라가고 진 쪽은 내려가요. Chatbot Arena에서는 사용자가 블라인드로 두 모델의 답변을 비교하고 승자를 고르면, 그 결과가 점수에 반영돼요.

점수 차이를 해석하는 기준은 이래요. 10점 이내는 통계적으로 유의미하지 않아요. 사실상 동급이에요. 30점 이상 벌어지면 체감 차이가 나기 시작해요. 50점 이상이면 “확실히 이 모델이 낫다”고 말할 수 있어요.

주의할 점이 있어요. Elo 점수는 ‘평균적인 사용자 선호’예요. 코딩, 글쓰기, 수학, 한국어 같은 특정 분야에서는 순위가 완전히 달라질 수 있어요. 그래서 종합 순위만 보지 말고 용도별 순위도 확인해야 해요.

종합 순위 Top 10

순위는 매주 변동될 수 있어요. 최신 수치는 lmarena.ai에서 확인하세요.

| 순위 | 모델 | Elo | 개발사 | 유형 |

|---|---|---|---|---|

| 1 | Claude Opus 4.6 | 1505 | Anthropic | 상용 |

| 2 | Gemini 3.1 Pro | 1503 | 상용 | |

| 3 | GPT-5.4 | 1498 | OpenAI | 상용 |

| 4 | GPT-5.2 | 1495 | OpenAI | 상용 |

| 5 | Grok 4.20 | 1488 | xAI | 상용 |

| 6 | Claude Sonnet 4.6 | 1482 | Anthropic | 상용 |

| 7 | DeepSeek V4 | 1475 | DeepSeek | 오픈소스 |

| 8 | Gemini 3 Pro | 1470 | 상용 | |

| 9 | Llama 4 405B | 1462 | Meta | 오픈소스 |

| 10 | Qwen 3.5 72B | 1455 | Alibaba | 오픈소스 |

1~4위가 10점 이내 차이예요. 통계적으로 사실상 동급이라고 봐야 해요. Claude Opus 4.6과 Gemini 3.1 Pro는 2점 차이, GPT-5.4와는 7점 차이예요. 어느 날 다시 재면 순위가 바뀔 수 있는 범위예요.

주목할 부분은 7위 DeepSeek V4예요. 오픈소스 모델이 상용 모델과 30점 이내 차이까지 좁혔어요. 1년 전만 해도 오픈소스와 상용 모델 사이에 100점 이상 벌어져 있었는데, 그 간극이 눈에 띄게 줄었어요.

코딩 순위 Top 10

| 순위 | 모델 | Elo (코딩) | 개발사 |

|---|---|---|---|

| 1 | Claude Opus 4.6 | 1561 | Anthropic |

| 2 | GPT-5.4 | 1542 | OpenAI |

| 3 | Gemini 3.1 Pro | 1528 | |

| 4 | Claude Sonnet 4.6 | 1520 | Anthropic |

| 5 | DeepSeek V4 | 1510 | DeepSeek |

| 6 | Grok 4.20 | 1498 | xAI |

| 7 | GPT-5.2 | 1492 | OpenAI |

| 8 | Qwen 3.5 72B | 1478 | Alibaba |

| 9 | Llama 4 405B | 1465 | Meta |

| 10 | Mistral Large 4 | 1452 | Mistral |

코딩 영역에서는 Claude Opus 4.6이 확실한 1위예요. 2위 GPT-5.4와 19점 차이인데, 코딩 분야에서 이 정도면 체감 차이가 나기 시작하는 구간이에요. Claude는 오래된 코드 리팩토링이나 복잡한 디버깅에서 특히 강해요.

오픈소스 쪽에서는 DeepSeek V4가 5위로 상용 모델과 섞여 있어요. Qwen 3.5도 8위에 올라왔어요. 코딩 도구에 비용을 안 쓰고 싶다면 주목할 만한 선택지예요.

오픈소스 모델 순위

| 순위 | 모델 | Elo (종합) | 파라미터 | 라이선스 |

|---|---|---|---|---|

| 1 | DeepSeek V4 | 1475 | MoE | MIT |

| 2 | Llama 4 405B | 1462 | 405B | Llama License |

| 3 | Qwen 3.5 72B | 1455 | 72B | Apache 2.0 |

| 4 | Gemma 4 31B | 1438 | 31B | Apache 2.0 |

| 5 | Mistral Small 4 | 1425 | 22B | Apache 2.0 |

오픈소스 1위 DeepSeek V4와 종합 1위 Claude Opus 4.6의 차이가 30점이에요. 1년 전에는 이 간극이 100점 넘었어요. 오픈소스가 빠르게 따라잡고 있다는 걸 숫자가 보여줘요.

로컬에서 돌릴 수 있는 소형 모델로는 Gemma 4와 Mistral Small 4가 강력한 선택지예요. Gemma 4 E4B는 노트북에서도 돌아가는 경량 모델인데, 지침 따르기 능력이 이전 세대 대비 크게 향상됐어요.

용도별 추천 — 어떤 모델을 고를까요?

코딩·개발 작업: Claude Opus 4.6이 현재 1위예요. 긴 코드베이스 이해, 리팩토링, 디버깅에서 가장 강해요. 비용이 부담되면 Claude Sonnet 4.6이 성능 대비 가격이 좋아요.

일반 대화·글쓰기: Claude Opus 4.6, GPT-5.2, Gemini 3.1 Pro 셋 다 비슷해요. 개인 취향으로 고르면 돼요. 한국어 글쓰기는 Claude가 약간 자연스럽다는 평이 많아요.

다국어·번역: Gemini 3.1 Pro가 강해요. Google의 다국어 데이터가 많이 반영된 결과예요. 한국어-영어 번역에서 특히 좋은 성능을 보여요.

비용 절약·로컬 실행: Gemma 4(4B/31B), Qwen 3.5, Llama 4 계열이 좋아요. API 비용 없이 내 컴퓨터에서 돌릴 수 있어요. 개인정보 보호가 중요한 용도에도 적합해요.

2026년 전반기 흐름 — 뭐가 바뀌었나요?

가장 큰 변화는 ‘절대 강자’가 사라졌다는 거예요. 2025년에는 GPT-4가 오랫동안 1위를 유지했어요. 2026년에는 Claude, GPT, Gemini가 돌아가며 1위를 차지해요. 2월에 Gemini 3 Pro가 1492 Elo로 1위를 찍었다가, 4월에는 Claude Opus 4.6이 1505로 올라왔어요.

두 번째 변화는 오픈소스의 추격이에요. DeepSeek V4, Llama 4, Qwen 3.5가 1년 전 상위 상용 모델 수준에 도달했어요. 소형 모델도 발전했어요. Gemma 4 E4B처럼 노트북에서 돌아가는 모델이 실용적인 수준이 됐어요.

세 번째는 전문 분야별 차별화예요. 종합 순위에서 비슷하더라도, 코딩·수학·다국어·창작 글쓰기 같은 세부 영역에서는 순위가 크게 달라져요. “종합 1위”보다 “내 용도에 맞는 1위”를 찾는 게 더 중요한 시대가 됐어요.

벤치마크의 한계 — 순위가 전부가 아니에요

LMSYS Chatbot Arena가 가장 신뢰할 만한 벤치마크인 건 맞지만, 한계도 있어요. 영어 중심 테스트라서 한국어 성능은 별도로 봐야 해요. 단일 답변 비교라서 멀티턴 대화나 에이전트 능력은 제대로 측정 안 돼요.

또 하나, 벤치마크 최적화(벤치마크 점수에만 맞춘 튜닝) 가능성도 항상 있어요. 실제 업무에 쓸 때는 벤치마크 순위와 체감이 다를 수 있어요. 이 표는 참고 자료로 쓰되, 본인 용도에 맞게 직접 써보고 결정하는 게 가장 정확해요.

마지막으로, API 가격과 응답 속도도 모델 선택에 중요한 요소예요. 성능이 비슷하다면 비용과 속도가 결정적인 차이가 돼요. 이 부분은 별도 글에서 다룰 예정이에요.

FAQ

Q. LMSYS Chatbot Arena가 뭔가요?

사용자들이 두 AI 모델의 답변을 블라인드로 비교하고 승자를 고르는 벤치마크 플랫폼이에요. Elo 점수로 순위를 매기며, 자체 벤치마크보다 실사용 선호도를 반영해요.

Q. 현재 가장 좋은 AI 모델은 뭔가요?

2026년 4월 기준, Claude Opus 4.6과 GPT-5.2가 통계적 동률이에요. 용도별로 다르기 때문에 절대 1위는 없어요. 코딩은 Claude, 다국어는 Gemini가 강해요.

Q. 오픈소스 모델도 경쟁이 되나요?

격차가 빠르게 줄고 있어요. DeepSeek V4는 종합 7위로, 상용 모델과 30점 이내 차이예요. 로컬 실행이 가능한 소형 모델도 점점 강력해지고 있어요.

Q. Elo 점수 10점 차이는 큰 건가요?

아니요. 10점 이내는 통계적으로 유의미하지 않아요. 동급이라고 봐야 해요. 30점 이상 차이가 나야 체감 차이가 시작돼요.

Q. 이 순위가 매달 바뀌나요?

네, 거의 매주 바뀌어요. 새 모델 출시, 기존 모델 업데이트, 사용자 평가 누적에 따라 변동돼요. 이 글은 매월 업데이트할 예정이에요.

마무리

2026년 4월 현재, AI 모델 시장은 삼국지예요. Claude, GPT, Gemini가 매달 엎치락뒤치락하고, 오픈소스가 아래에서 빠르게 치고 올라오고 있어요. “어떤 게 최고냐”보다 “내 용도에 어떤 게 맞냐”가 더 중요한 질문이에요.

이 순위표는 매월 업데이트할 예정이에요. 새 모델이 나오거나 큰 변동이 있으면 반영할게요. 북마크해두면 매달 확인할 수 있어요.

이 글은 2026년 4월 4일에 작성됐어요. LMSYS Chatbot Arena(lmarena.ai) 데이터를 기반으로 해요. 순위는 매주 변동될 수 있으므로, 최신 수치는 직접 확인해주세요. 매월 업데이트할 예정이에요.

GoCodeLab에서는 AI 도구를 직접 써보고 솔직하게 알려드려요. 다른 AI 소식이 궁금하면 블로그를 구독해주세요.