LTX 2.3 — 무료 AI 영상 생성, Sora 대신 쓸 수 있을까요?

LTX 2.3 — 무료 AI 영상 생성, Sora 대신 쓸 수 있을까요?

2026년 3월 20일 · A. 비교

이번 주 AI 영상 생성 분야에서 조용하지만 큰 변화가 생겼어요. Lightricks의 LTX 2.3 로컬 버전이 오픈소스로 공개됐거든요. 4K 화질에 오디오까지 동시에 생성하는 22B 파라미터 모델이에요. 지금까지 AI 영상 생성은 유료 구독이 있어야 쓸만한 수준이었는데, 그 공식이 흔들리고 있어요.

진짜 궁금한 건 하나예요. Sora, Kling, Runway Gen-3 같은 유료 서비스를 대신할 수 있을까요?

– LTX 2.3: 22B 파라미터, Apache 2.0 라이선스, 4K + 오디오 통합 생성

– Helios: ByteDance·북경대·Canva 공동 개발, 최대 60초 영상 생성

– Sora: OpenAI 유료 구독 필요, 품질 최상, 최대 20초

– Kling: 크레딧 기반 무료 플랜 존재, 최대 60초

– Runway Gen-3: 월 $12부터, 영화 수준 품질

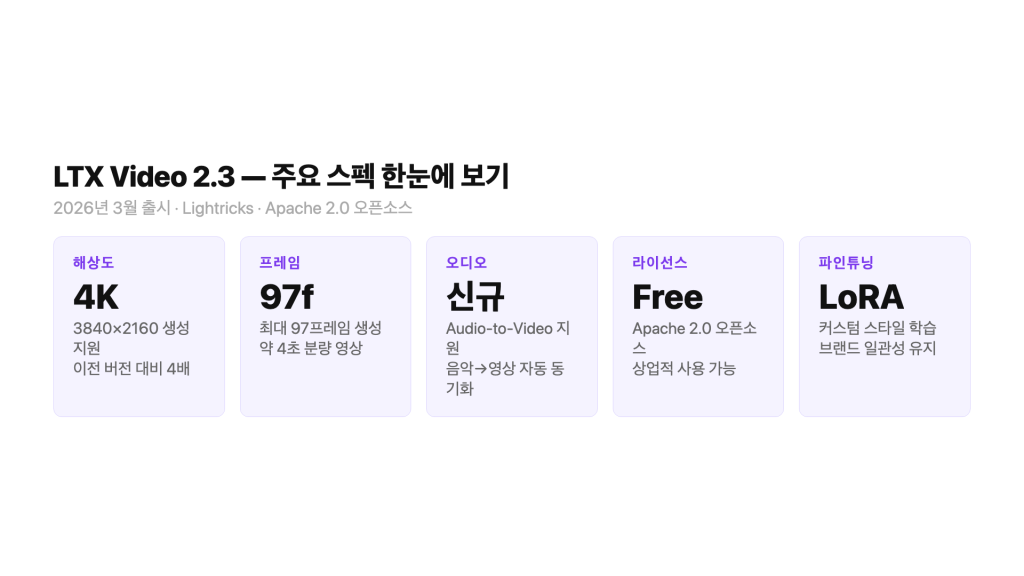

LTX 2.3 — 뭐가 달라요?

3월 17일 Lightricks가 LTX 2.3 로컬 배포 버전을 공개했어요. 가장 눈에 띄는 특징은 두 가지예요.

첫째, 오디오를 영상과 함께 생성해요. 기존 AI 영상 도구는 영상과 소리를 따로 만들어야 했어요. LTX 2.3은 한 번에 처리해요.

둘째, Apache 2.0 라이선스예요. 상업적으로 써도 되고, 코드를 수정해도 돼요. OpenAI나 Runway처럼 이용 약관에 묶이지 않아요.

기술 스펙은 이래요.

- 파라미터: 22B

- 최대 해상도: 4K

- 최대 영상 길이: 20초

- 지원 기능: text-to-video, image-to-video, audio-to-video, 영상 연장(extend), retake

- FPS 옵션: 24fps / 48fps

- LoRA 파인튜닝 지원

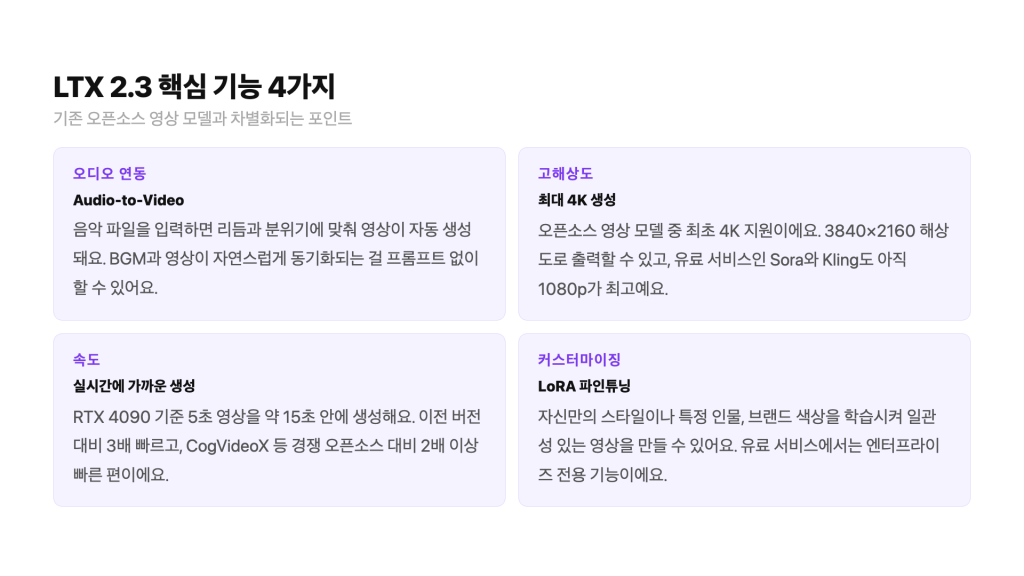

LoRA 지원이 특히 중요해요. 내 스타일로 모델을 훈련시킬 수 있거든요. 유료 서비스에선 불가능한 기능이에요. 크리에이터나 브랜드 영상 제작자에게 유리한 구조예요.

이전 버전과 비교하면, 신형 VAE가 들어가서 화면 디테일이 훨씬 선명해졌어요. 세로 9:16 비율도 지원해서 릴스나 쇼츠용 영상을 바로 만들 수 있어요.

Helios도 같이 등장했어요

같은 시기, ByteDance와 북경대, Canva가 공동 개발한 Helios도 공개됐어요. 14B 파라미터 모델인데 최대 60초 영상을 만들 수 있어요. NVIDIA H100 GPU 1개에서 초당 19.5 프레임 속도로 생성해요. 1,440 프레임을 24fps로 렌더링하면 정확히 60초 분량이에요.

오토리그레시브 디퓨전 방식을 써서, 이전 프레임을 참고하며 순서대로 만들어요. 그래서 긴 영상에서도 일관성이 유지되는 편이에요.

LTX 2.3과 Helios를 함께 보면, 오픈소스 AI 영상 생성이 드디어 실전급에 진입했다고 볼 수 있어요.

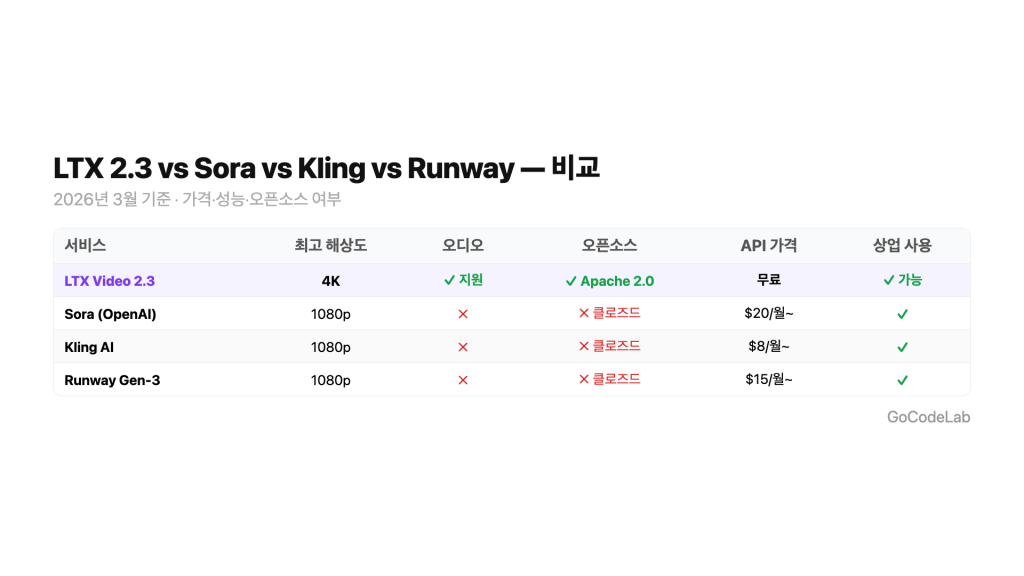

유료 서비스와 직접 비교해요

Sora (OpenAI)

ChatGPT Plus($20/월) 또는 Pro($200/월) 구독이 필요해요. 품질은 현재 업계 최고 수준이에요. 인물 표정, 복잡한 동작 장면에서 특히 강해요. 최대 20초, 1080p가 현재 한계예요. 오디오 생성은 아직 지원하지 않아요.

Kling (Kuaishou)

무료 플랜이 있어요. 크레딧이 소진되면 유료로 전환돼요. 최대 60초 영상이 가능하다는 게 큰 장점이에요. 한국어 인터페이스는 따로 없어요. 영상 품질은 Sora보다는 낮지만 꽤 쓸 만한 수준이에요.

Runway Gen-3 Alpha

월 $12부터 시작하는 유료 서비스예요. 영화 같은 감성을 원할 때 많이 써요. 최대 16초, 1080p예요. 세밀한 편집 기능과 프레임 단위 제어가 강점이에요. 콘텐츠 크리에이터나 광고 업계에서 많이 쓰는 툴이에요.

가격·해상도·오디오·오픈소스 기준 4개 모델 비교 / GoCodeLab

한눈에 비교

| 모델 | 가격 | 최대 길이 | 최대 해상도 | 오디오 | 라이선스 |

|---|---|---|---|---|---|

| LTX 2.3 | 무료 (로컬) | 20초 | 4K | 포함 | Apache 2.0 |

| Helios | 무료 (오픈소스) | 60초 | 1080p | 미공개 | 오픈소스 |

| Sora | $20+/월 | 20초 | 1080p | 미포함 | 폐쇄형 |

| Kling | 크레딧제 | 60초 | 1080p | 미포함 | 폐쇄형 |

| Runway Gen-3 | $12+/월 | 16초 | 1080p | 미포함 | 폐쇄형 |

어떤 상황에 뭘 쓸까요?

예산이 없거나 개인 프로젝트: LTX 2.3이에요. 로컬 설치 후 무료로 쓸 수 있어요. GPU만 있으면 돼요.

긴 영상이 필요할 때: Helios나 Kling이에요. LTX 2.3은 20초가 한계거든요.

최고 품질이 필요할 때: Sora나 Runway예요. 인물 영상, 복잡한 동작은 아직 유료가 앞서요.

오디오까지 한 번에 원할 때: 지금은 LTX 2.3이 유일해요. 영상·소리 통합 생성 오픈소스는 이게 처음이에요.

내 브랜드 스타일로 커스터마이징: LTX 2.3만 LoRA를 공식 지원해요. 특정 스타일이나 인물을 학습시킬 수 있어요.

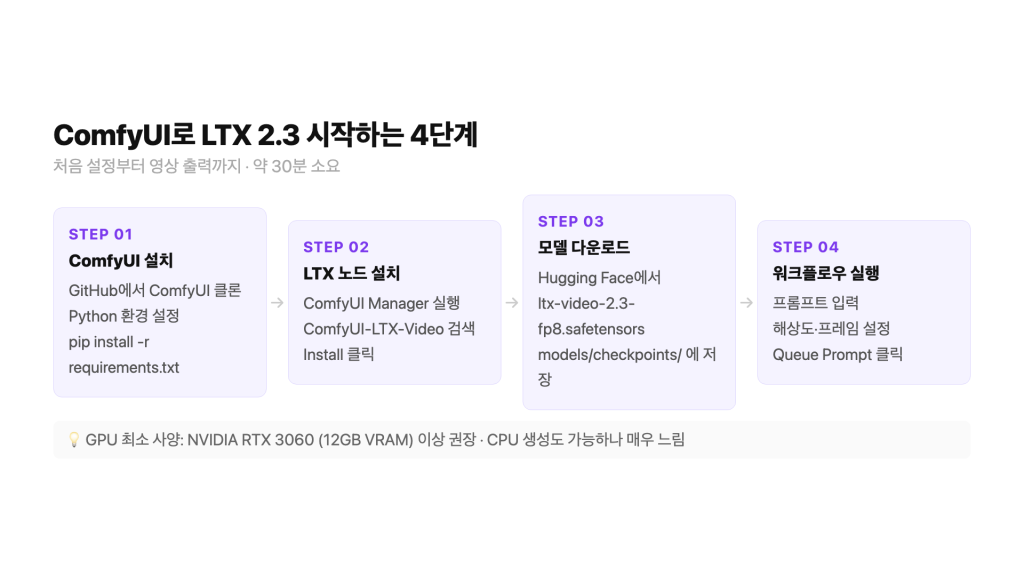

LTX 2.3, 어떻게 시작하면 돼요?

로컬 설치 방법은 두 가지예요. 직접 Python 환경에 설치하거나, ComfyUI를 통해 GUI로 쓰는 방법이에요.

ComfyUI로 시작하는 게 제일 쉬워요

ComfyUI는 AI 이미지·영상 생성을 노드 기반 GUI로 다룰 수 있는 오픈소스 도구예요. 코딩 없이도 LTX 2.3을 바로 써볼 수 있어요.

- ComfyUI를 설치해요. GitHub에서 받거나, ComfyUI Desktop 버전을 설치하면 더 간편해요.

- ComfyUI Manager에서 “LTX-Video”를 검색하고 설치해요.

- HuggingFace에서 LTX 2.3 모델 웨이트를 다운받아 models/video_models 폴더에 넣어요.

- LTX 2.3용 워크플로우 JSON을 불러오면 바로 영상 생성이 가능해요.

처음 실행하면 모델 파일(약 12GB)을 다운받아야 해요. GPU VRAM이 24GB라면 4K 생성도 가능해요. 16GB면 1080p, 8GB면 720p 이하로 제한해요.

audio-to-video가 정확히 뭔가요?

LTX 2.3의 오디오 기능은 두 가지 방향으로 써요.

첫째, 오디오 입력에서 영상을 생성해요. 음악 파일이나 사운드를 넣으면, 그 오디오에 맞는 영상을 자동으로 만들어줘요. 뮤직비디오나 오디오 비주얼라이저를 만들 때 유용해요.

둘째, 영상 생성과 배경음을 동시에 만들어요. 텍스트 프롬프트만 입력해도 영상과 어울리는 배경음이 함께 생성돼요. 기존에는 영상 만들고 → 음악 따로 추가하는 두 단계가 필요했는데, 이제 한 번에 가능해요.

이 기능이 중요한 이유는, 오픈소스 모델 중에서 오디오 통합 생성을 지원하는 게 지금은 LTX 2.3이 사실상 유일하기 때문이에요.

LTX 2.3, 실제로 어떻게 활용하면 좋을까요?

기능 목록만 보면 와닿지 않으니까, 구체적인 활용 시나리오로 정리해볼게요.

유튜버·콘텐츠 크리에이터

배경 영상이나 인트로 클립을 매번 직접 촬영하거나 스톡 영상을 구매하던 분들께 딱이에요. 텍스트 프롬프트만 입력하면 몇 십 초 안에 1080p~4K 영상이 나오거든요. 배경음악 파일까지 함께 넣으면 오디오가 영상에 맞게 동기화돼요. 인트로 영상, 로고 애니메이션, B-roll 용도로 쓰기에 충분해요.

브랜드 영상 담당자

LoRA 파인튜닝 지원이 핵심이에요. 브랜드 색상, 로고 스타일, 특정 인물을 학습시켜 두면 일관성 있는 영상을 자동으로 뽑을 수 있어요. 유료 서비스에선 이 기능을 쓰려면 엔터프라이즈 계약이 필요해요. LTX 2.3은 무료예요.

개발자·연구자

Apache 2.0이라 모델 구조를 직접 수정하거나, 다른 파이프라인에 통합할 수 있어요. ComfyUI 노드 기반으로 워크플로우를 자유롭게 구성할 수 있고, Python API로도 바로 연동돼요.

GPU가 없다면? LTX 2.3은 Hugging Face Spaces에서 데모 버전을 무료로 체험할 수 있어요. 단, 해상도 제한이 있고 대기 시간이 발생할 수 있어요.

FAQ

Q. LTX 2.3을 실행하려면 어떤 GPU가 필요해요?

NVIDIA GPU 기준 VRAM 24GB 이상을 권장해요. RTX 3090, RTX 4080, RTX 4090이면 편하게 돌아가요. 8GB VRAM으로도 낮은 해상도에서는 실행이 가능해요. Mac M 시리즈 지원은 아직 제한적이에요. AMD GPU는 공식 지원이 아직 불안정해요.

Q. Sora와 LTX 2.3, 품질 차이가 얼마나 커요?

인물 표정, 세밀한 손동작, 물리 시뮬레이션은 Sora가 아직 앞서요. 풍경, 추상적 장면, 애니메이션 스타일은 LTX 2.3도 꽤 선전해요. 완성도 차이는 분명히 있지만, 무료 오픈소스 치고는 놀라운 수준이에요. 6개월 뒤 버전에서는 격차가 더 좁혀질 거예요.

Q. LTX 2.3으로 만든 영상을 유튜브에 올려도 되나요?

Apache 2.0 라이선스라 상업적 사용이 가능해요. 다만 AI 생성 콘텐츠임을 표시하는 건 플랫폼 정책에 따라 필요할 수 있어요. 유튜브는 현재 AI 영상 명시를 권장하고 있어요. 수익화 자체를 막지는 않아요.

Q. Helios는 어디서 다운받을 수 있어요?

GitHub 공식 레포에서 코드를 받을 수 있어요. 아직 공식 데모 웹사이트는 없어요. LTX 2.3보다 설치 과정이 더 복잡할 수 있어요. 향후 HuggingFace에 모델 가중치가 올라올 예정이에요.

Q. Runway나 Sora 구독을 끊고 LTX 2.3으로 갈아타야 할까요?

아직은 급할 필요 없어요. 전문 영상 제작이 목적이라면 유료 서비스 품질이 우위예요. LTX 2.3은 실험, 프로토타입, 개인 프로젝트에 적합해요. 6개월~1년 뒤에는 답이 달라질 수 있어요.

마무리

LTX 2.3의 등장으로 AI 영상 생성의 문턱이 낮아졌어요. 1년 전이라면 이 수준의 영상을 얻으려면 월 구독료가 필요했어요. 이제는 GPU만 있으면 무료로 4K 영상을 만들 수 있어요.

최고 품질을 원한다면 Sora나 Runway가 여전히 앞서요. 하지만 오픈소스가 이 속도로 따라온다면, 1~2년 안에 판도가 달라질 거예요. Helios가 60초 영상을 무료 오픈소스로 내놨다는 것 자체가 이미 그 신호예요.

AI 영상 생성 최신 소식이 궁금하다면 GoCodeLab 블로그를 구독해요.

이 글은 2026년 3월 20일에 작성됐어요. AI 모델은 빠르게 업데이트되므로 최신 정보는 각 공식 사이트에서 확인하세요.

GoCodeLab에서는 AI 도구를 직접 써보고 솔직하게 알려드려요. 다른 AI 소식이 궁금하면 블로그를 구독해주세요.