Google Search Live — 카메라로 말 걸면 구글이 답해줘요

Google Search Live — 카메라로 말 걸면 구글이 답해줘요

2026년 3월 27일 · 가이드

구글이 드디어 카메라로 말하는 검색을 전세계에 열었어요. 어제(3월 26일), Google Search Live가 AI 모드를 지원하는 200개국 이상에 동시 출시됐어요. 스마트폰을 들고 냉장고 속 재료를 비추면서 “이걸로 뭘 만들 수 있어요?”라고 물어볼 수 있는 기능이에요. 텍스트 타이핑 없이요.

기존 구글 렌즈가 “이 식물이 뭐예요?”처럼 단발성 질문에 답했다면, Search Live는 연속 대화가 돼요. 카메라가 보는 장면을 공유하면서 구글과 대화를 이어갈 수 있어요. Gemini 3.1 Flash Live라는 새 모델이 뒤를 받쳐줘요. 출시 하루 만에 직접 써봤고, 이 글에 정리했어요.

– Google Search Live: 카메라+음성으로 구글과 대화하는 검색 기능

– 기반 모델: Gemini 3.1 Flash Live (3월 26일 함께 출시)

– 지원 범위: AI 모드 사용 가능한 200개국 이상, 한국 포함

– 실행 방법: 구글 앱 → 검색창 아래 Live 아이콘 탭

– 이전 버전 대비 응답 속도 향상, 대화 기억 2배, 소음 환경 개선

– ChatGPT Vision·Copilot보다 맥락 유지가 강하고, 구글 웹 연동 검색 지원

Google Search Live가 뭔가요?

검색창에 타이핑하는 시대는 조금씩 끝나가고 있어요. Search Live는 스마트폰 카메라를 켜고 말을 걸면, 구글이 카메라가 보는 화면을 실시간으로 분석하면서 대화해주는 기능이에요. 음성 명령 하나에 단답형으로 끝나는 게 아니라, 후속 질문을 이어갈 수 있어요.

기존 구글 렌즈와 비교하면 차이가 명확해요. 렌즈는 이미지를 찍은 뒤 결과를 보여주는 방식이에요. Search Live는 카메라 화면이 켜진 채로 대화가 계속돼요. 예를 들면 “이 식재료로 뭘 만들 수 있어요?” → “양파 없어도 돼요?” → “몇 인분 기준이에요?” 같은 흐름이 자연스럽게 이어져요.

이 기능이 처음은 아니었어요. 미국과 인도에서 먼저 테스트하다가, 3월 26일에 AI 모드가 열려 있는 전 세계 200개국 이상으로 동시 확장됐어요. 한국에서도 구글 앱 최신 버전이라면 지금 바로 써볼 수 있어요.

Gemini 3.1 Flash Live — 핵심 기술

Search Live의 두뇌 역할을 하는 게 Gemini 3.1 Flash Live예요. 구글이 “지금까지 만든 오디오·음성 모델 중 품질이 가장 높다”고 설명한 모델이에요. Search Live 글로벌 출시와 같은 날(3월 26일) 공개됐어요.

이전 모델 대비 달라진 점이 세 가지예요. 첫째, 응답 속도가 더 빨라졌어요. 말이 끝나자마자 거의 바로 답이 나오는 느낌이에요. 둘째, 소음 환경에서 내 목소리 구분 능력이 올라갔어요. TV가 켜진 방이나 카페처럼 배경음이 있는 곳에서도 잘 인식해요. 셋째, 대화 맥락 기억이 이전보다 2배 더 길어졌어요. 긴 브레인스토밍 도중 앞 내용을 잊어버리는 문제가 많이 줄었어요.

다국어 지원도 기본으로 들어갔어요. 언어를 따로 설정하지 않아도 한국어로 말하면 한국어로 답해줘요. 직접 한국어로 “이게 뭔가요?”라고 해봤고, 무리 없이 대화가 됐어요. 완벽하진 않지만 실용적인 수준은 됐어요. 특히 언어를 전환할 필요 없이 자연스럽게 한국어로 이어갈 수 있다는 게 편해요.

Gemini 3.1 Flash Live는 개발자 API로도 제공돼요. 실시간 대화형 에이전트를 직접 만들고 싶다면 Google AI Studio에서 바로 테스트해볼 수 있어요.

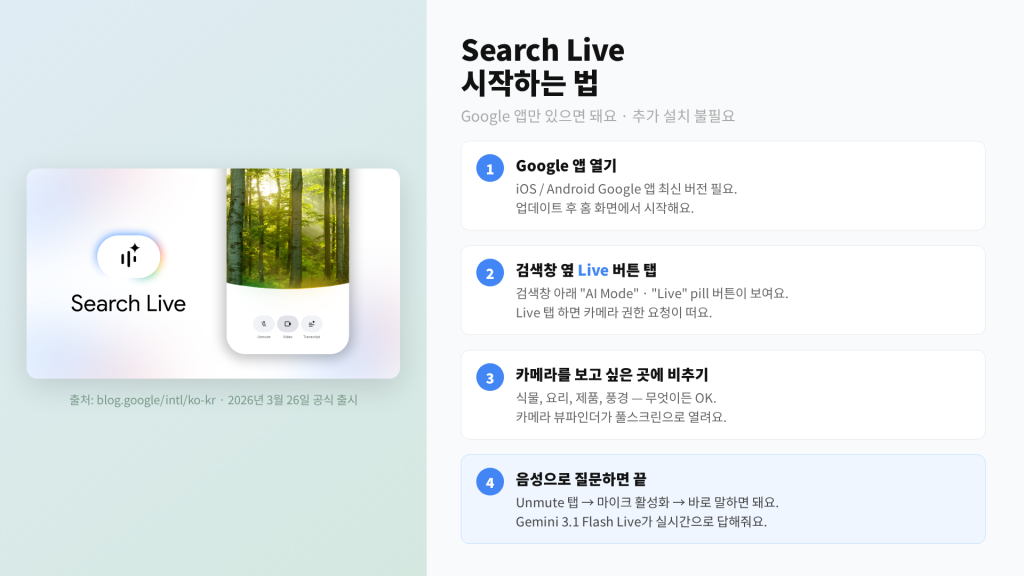

지금 바로 시작하는 법

설정이 복잡하지 않아요. 앱 하나면 충분해요. Android와 iOS 모두 지원해요.

가장 기본적인 방법은 이래요. 구글 앱을 열면 검색창 바로 아래에 새 아이콘이 생겼어요. “Live”라고 쓰인 아이콘이에요. 탭하면 카메라와 마이크 권한을 요청해요. 허용하면 바로 대화 모드가 시작돼요. 말을 걸면 돼요.

구글 렌즈를 자주 쓴다면 더 빠른 방법이 있어요. 렌즈 화면 아래쪽에 “Live” 탭이 새로 생겼어요. 뭔가를 렌즈로 비추다가 바로 대화 모드로 전환할 수 있어요. 렌즈로 찍고 → 결과 보고 → 추가 질문하는 흐름이 한 화면 안에서 이어져요.

구글 앱 Live 아이콘 탭 → 대화 시작 흐름 / GoCodeLab

| 실행 방법 | 경로 | 추천 상황 |

|---|---|---|

| 구글 앱에서 바로 | 검색창 아래 Live 아이콘 | 처음 쓸 때 |

| 구글 렌즈에서 전환 | 렌즈 하단 “Live” 탭 | 이미 렌즈를 쓰다가 질문이 생겼을 때 |

| AI 모드에서 연계 | AI 모드 → 카메라 아이콘 | 텍스트 검색하다가 시각 정보가 필요해졌을 때 |

카메라를 켜면 뭐가 달라지나요?

카메라를 쓰는 것과 안 쓰는 것의 차이가 꽤 커요. 카메라 없이 음성만 쓰면 일반 AI 음성 검색이에요. 카메라를 켜는 순간, 구글이 내 시야를 공유받아요. 눈앞의 상황을 설명할 필요가 없어져요.

세탁기 고장이 났을 때를 예로 들면, 에러 코드가 뜬 세탁기 화면을 카메라로 비추고 “이 에러 코드가 뭔가요?”라고 말하면 돼요. “E4 에러코드”라고 타이핑할 필요가 없어요. 구글이 화면을 읽고, 해당 브랜드의 A/S 안내까지 같이 가져다줘요.

개인적으로 꽤 인상 깊었던 건 카메라 전환 속도예요. 카메라를 켜도 대화 흐름이 끊기지 않아요. 말하면서 카메라를 이동시켜도 그 변화를 실시간으로 따라와요. 가구 조립 중에 “이 부품 어디에 끼워요?”라고 물어보면서 카메라를 이리저리 돌려도 맥락을 잘 잡아요.

한 가지 주목할 점은 배터리 소모예요. 카메라와 마이크를 동시에 켜고 실시간 처리를 하니까, 일반 검색보다 배터리를 더 써요. 5분 정도 연속 사용하면 배터리 2~3% 정도가 빠지는 느낌이에요. 오래 쓸 계획이라면 충전 케이블을 챙겨두는 게 편해요.

실전 활용 시나리오 7가지

써보면서 “이럴 때 쓸 만하겠다”고 느낀 상황들을 정리했어요.

1. 마트에서 낯선 식재료 파악

처음 보는 채소나 수입 과일을 들고 카메라로 비추면서 “이게 뭔가요? 어떻게 요리해요?”라고 물어볼 수 있어요. 대화를 이어가면서 레시피 재료, 보관 방법까지 물어볼 수 있어요. 타이핑 없이 두 손이 자유로워요.

2. 가구 조립 중 막혔을 때

설명서가 불분명할 때 해당 부품을 카메라로 보여주면서 물어보면 구글이 시각 정보를 바탕으로 안내해줘요. “이 나사 방향이 맞나요?”라고 들이대면 확인해줘요. 직접 써봤고, 꽤 실용적이었어요.

3. 해외여행 중 메뉴 해석

외국 식당 메뉴판을 카메라로 비추면서 “이 요리 어떤 재료가 들어가요? 채식이에요?”라고 물어볼 수 있어요. 번역과 추가 질문이 하나의 대화 흐름 안에서 해결돼요.

4. 오래된 물건 시세 확인

중고 거래 현장에서 물건을 카메라로 찍고 “이거 시세가 얼마예요? 어느 브랜드 제품이에요?”라고 물어볼 수 있어요. 협상 전에 빠르게 정보를 얻고 싶을 때 유용해요.

5. 자연 탐구

공원에서 꽃이나 곤충을 카메라로 찍고 “이게 무슨 식물이에요? 독성이 있나요?”라고 물어볼 수 있어요. 구글 렌즈의 식물 인식 능력이 대화 기능과 합쳐진 느낌이에요.

6. 공부·과제 중 실물 자료 분석

교재를 카메라로 비추면서 “이 그래프가 무슨 의미예요? 좀 더 쉽게 설명해줄 수 있어요?”라고 물어볼 수 있어요. 교재 이미지를 캡처해서 붙여넣을 필요 없이, 그냥 책을 카메라에 비추면 돼요. 수식이나 도표도 인식해요.

7. DIY 수리·인테리어 중 자재 확인

철물점에서 부품 카메라로 비추고 “이 나사가 M6 규격인가요? 호환되는 드릴비트가 뭔가요?”라고 물어볼 수 있어요. 숙련된 DIYer가 아니어도 적합한 부품을 고를 수 있어요.

Search Live는 인터넷 연결이 필요해요. 오프라인 환경이나 느린 네트워크에서는 응답이 지연되거나 연결이 끊길 수 있어요. 해외여행 중에는 데이터 로밍 설정을 미리 확인해두는 게 좋아요.

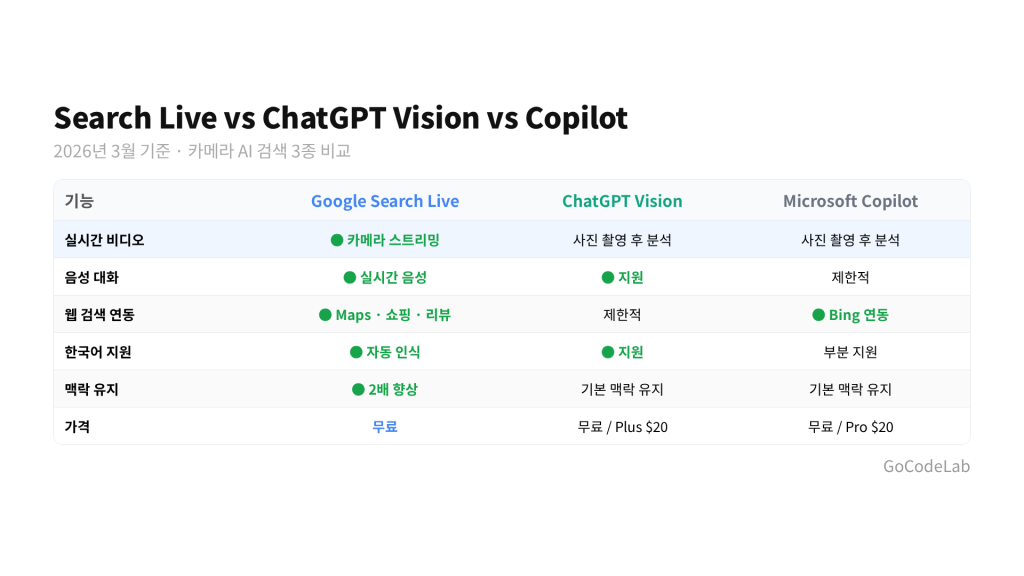

ChatGPT Vision vs Copilot vs Search Live

요즘 AI 카메라 검색 기능이 이 서비스에만 있는 게 아니에요. 어떻게 다른지 직접 비교해봤어요.

ChatGPT(OpenAI)는 GPT-4o Vision이 사진 한 장을 분석하는 방식이에요. 실시간 연속 대화는 현재 Advanced Voice Mode에서 가능하지만, 웹 검색 결과와 실시간으로 연동되지 않아요. 구글 Search Live의 가장 큰 장점은 답변에 웹 검색 결과를 바로 가져온다는 점이에요. 레시피, 쇼핑, 뉴스가 연결돼요.

Microsoft Copilot은 Bing 검색과 연동이 강점이에요. 다만 카메라 연속 대화 기능은 Search Live만큼 매끄럽지 않아요. 구글 생태계(Maps, Shopping, 리뷰 등)를 자주 쓰는 사람이라면 Search Live 쪽이 훨씬 자연스럽게 연결돼요.

| 기능 | Google Search Live | ChatGPT Vision | Copilot |

|---|---|---|---|

| 실시간 카메라 스트리밍 | 지원 | 부분 지원 | 부분 지원 |

| 웹 검색 결과 연동 | 강력 | 제한적 | 강력 (Bing) |

| 한국어 자연스러움 | 우수 | 우수 | 보통 |

| 대화 맥락 유지 | 최대 2배 개선 | 우수 | 보통 |

| 구글 서비스 연결 | Maps·쇼핑·리뷰 | 없음 | 없음 |

| 무료 사용 | 무료 | 플랜 제한 있음 | 무료 |

개인정보와 데이터 보관 — 솔직한 정리

Search Live를 쓰면서 가장 많이 받는 질문이 개인정보 관련이에요. 카메라로 내 주변을 실시간으로 보여주는 게 불안하다는 반응이 많아요. 알려진 사실과 아직 불분명한 부분을 솔직하게 정리했어요.

구글 공식 발표 기준으로, Search Live는 카메라 스트림을 실시간으로 처리하고 별도로 저장하지 않아요. 하지만 구글이 상세한 데이터 보관 정책을 공식 문서에 아직 명확하게 밝히지 않은 부분이 있어요. 구글 계정에 연결된 상태에서 사용하면 검색 기록은 남을 수 있고, 이는 광고 맞춤화에 활용될 수 있어요.

현실적으로 조심해야 할 상황이 있어요. 병원 서류, 은행 통장, 계약서처럼 민감한 개인 정보가 포함된 문서를 카메라에 비추는 건 피하는 게 좋아요. 사적인 대화나 비밀 자료가 있는 공간에서는 사용에 주의를 기울이는 게 합리적이에요. 반대로 마트에서 식재료 확인하거나 길에서 건물 정보 물어보는 정도는 걱정할 필요가 없어요.

구글 계정 설정에서 “검색 기록 자동 삭제” 주기를 3개월이나 18개월로 설정해두면 Search Live 관련 기록도 자동으로 삭제돼요. 마이 구글 활동(myactivity.google.com)에서 수동 삭제도 가능해요.

Google Home과도 연동돼요

스마트폰에서만 쓸 수 있는 게 아니에요. Google Home과의 연동이 최근 업데이트됐어요. 가정에 설치된 보안 카메라나 스마트 도어벨의 라이브 피드를 Gemini가 분석할 수 있어요. “현관 카메라 켜봐, 택배 왔는지 확인해줘”라고 말하면 Google Home 디스플레이나 스마트 TV 화면에서 바로 확인할 수 있어요.

가정 내 카메라 연동은 아직 초기 단계예요. Nest 카메라 계열과 호환이 잘 되고, 서드파티 카메라는 모델에 따라 지원 여부가 달라요. 하지만 방향 자체가 스마트홈과 AI 검색을 하나로 묶는 쪽이라, 앞으로 더 넓어질 것 같아요.

FAQ

Q. 한국에서도 바로 쓸 수 있나요?

네, 쓸 수 있어요. Search Live는 구글의 AI 모드가 활성화된 200개국 이상에서 동시 출시됐고, 한국도 포함돼요. 구글 앱을 최신 버전으로 업데이트하고 검색창 아래 Live 아이콘을 탭하면 바로 시작할 수 있어요. iOS와 Android 모두 지원해요. 아이콘이 보이지 않는다면 앱 업데이트부터 확인해보세요.

Q. 데이터를 얼마나 소모하나요?

카메라 스트리밍이 실시간으로 이뤄지기 때문에 일반 텍스트 검색보다 데이터를 더 써요. 대략 유튜브 저화질(360p) 스트리밍과 비슷한 수준이에요. 1분 사용에 약 10~20MB 정도로 보면 돼요. Wi-Fi 환경에서는 신경 쓸 필요 없지만, LTE로 쓴다면 장시간 연속 사용은 주의가 필요해요.

Q. 기존 구글 렌즈와 뭐가 다른 건가요?

렌즈는 사진 한 장을 찍고 결과를 보여주는 방식이에요. Search Live는 카메라를 계속 켜둔 채로 대화를 이어가는 방식이에요. 렌즈는 단발성 인식에 강하고, Search Live는 맥락이 이어지는 연속 질문에 강해요. 렌즈가 “이게 뭔지 알아봐줘”라면, Search Live는 “이것 관련해서 대화해줘”에 가깝다고 볼 수 있어요.

Q. 개인정보는 괜찮나요? 카메라 영상이 저장되나요?

구글 공식 발표 기준으로, Search Live는 카메라 스트림을 실시간으로 처리하고 별도로 저장하지 않아요. 다만 구글 계정에 연결된 상태에서 사용하면 검색 기록은 남을 수 있어요. 개인 정보가 민감한 장소(병원, 금고, 개인 서류 등)를 카메라로 비추는 건 피하는 게 좋아요. 구글 계정 → 데이터 보안 설정에서 활동 기록 자동 삭제를 설정해두면 더 안심돼요.

Q. iOS와 Android 중 어느 쪽이 더 잘 돼요?

둘 다 지원하지만, 초기 출시 경험상 Android 쪽이 조금 더 매끄러워요. Android는 구글이 직접 만드는 OS라 앱 통합이 자연스러워요. iOS에서도 구글 앱을 최신 버전으로 유지하면 동일한 기능을 쓸 수 있어요. 아이폰 사용자라면 구글 앱 업데이트부터 확인해보세요.

Q. 구글 렌즈 앱과 구글 앱, 어느 앱에서 써야 하나요?

별도 설치 없이 구글 앱 하나면 돼요. 구글 앱의 검색창 아래 Live 아이콘을 탭하면 바로 시작할 수 있어요. 구글 렌즈 앱에서도 하단 “Live” 탭으로 진입할 수 있지만, 구글 앱 쪽이 더 직접적인 경로예요. 어느 쪽을 써도 동일한 기능이에요.

Q. 배터리가 많이 닳나요?

카메라와 마이크를 동시에 쓰고 실시간 AI 처리까지 하니까, 일반 검색보다 배터리 소모가 빠른 건 사실이에요. 5분 연속 사용에 대략 2~3% 소모가 체감돼요. 짧게 필요할 때만 켜고 끄는 방식으로 쓰면 부담이 없어요. 장시간 사용이 필요하다면 보조 배터리를 챙기는 게 좋아요.

마무리

Google Search Live는 “카메라로 검색한다”는 개념을 대화 형태로 한 단계 끌어올린 기능이에요. 렌즈로 찍고 결과 보는 것에서 끝나지 않고, 그 화면을 보면서 계속 물어볼 수 있어요. 실제로 써보면 예상보다 자연스러워요.

모든 상황에서 빛나진 않아요. 네트워크가 느리면 답변이 버벅거리고, 아직 복잡한 전문 질문은 텍스트 검색보다 얕게 답하는 경우도 있어요. 개인정보 관련 정책이 아직 명확하게 공개되지 않은 부분도 불편한 게 사실이에요. 하지만 빠른 정보 확인, 시각 정보가 필요한 상황에서는 꽤 실용적이에요.

ChatGPT Vision이나 Copilot과 비교했을 때, Search Live의 강점은 분명해요. 구글 검색 결과, 지도, 쇼핑 정보가 대화 흐름 안으로 자연스럽게 들어와요. 구글 생태계를 많이 쓰는 사람이라면 손이 자주 가는 기능이 될 것 같아요. 한국 포함 200개국에서 이미 열려 있으니, 구글 앱 업데이트 한 번이면 바로 써볼 수 있어요.

GoCodeLab에서는 AI 도구를 직접 써보고 솔직하게 알려드려요 — 구독하면 새 글을 빠르게 받아볼 수 있어요.

이 글은 2026년 3월 27일에 작성됐어요. Google Search Live 및 Gemini 3.1 Flash Live의 기능은 이후 업데이트에 따라 달라질 수 있어요.

관련 글: Google Gemini Workspace 활용법 · Apple Siri + Gemini 대개편 · MCP 프로토콜 9천700만 설치