Google DeepMind Vision Banana 공개 — 이미지 생성 사전학습으로 5개 시각 태스크를 단일 모델이 전부 제쳤다

Google DeepMind가 2026년 4월 공개한 Vision Banana는 단일 가중치로 5개 시각 태스크를 처리하며 Meta SAM 3와 Depth Anything V3를 동시에 압도했다. He Kaiming·Xie Saining 참여, 이미지 생성 사전학습이 일반 시각 표현 학습의 핵심임을 입증했다.

목차 (10)

- Vision Banana가 등장하기 전 — 비전 파이프라인의 현실

- Vision Banana — Nano Banana Pro 위에서 나온 모델

- 5개 태스크를 하나로 — 실제로 어떻게 처리하나

- Meta SAM 3를 segmentation에서 제쳤다

- Depth Anything V3도 넘어섰다 — metric depth 결과

- 이미지 생성 사전학습이 핵심이었다 — 논문의 주장

- 제로샷 전이 — 처음 보는 데이터셋에서도 통했다

- He Kaiming과 Xie Saining — 이 조합이 의미하는 것

- 지금 당장 써보기 — 설치부터 추론까지

- 기존 파이프라인에서 Vision Banana로 갈아타는 방법

2026년 5월 · AI 소식

Google DeepMind Vision Banana 공개 — 이미지 생성 사전학습으로 5개 시각 태스크를 단일 모델이 전부 제쳤다

비전 AI 파이프라인의 현실은 이렇다. segmentation 하나, depth 추정 하나, 이미지 생성 하나. 태스크마다 모델이 따로 붙는다. 파이프라인이 늘어날수록 모델도 쌓인다. GPU 메모리는 빠듯해지고, 추론 레이턴시는 누적되고, API 버전 호환은 골칫거리가 된다.

Google DeepMind가 2026년 4월 22일 그 구조를 뒤집었다. Vision Banana를 공개했다. 단일 가중치 하나에 5개 시각 태스크가 담겼다. Meta SAM 3를 segmentation에서 제쳤다. Depth Anything V3를 metric depth에서 압도했다. He Kaiming, Xie Saining이 참여한 논문 "Image Generators are Generalist Vision Learners"는 주장 하나를 벤치마크로 입증했다.

이미지 생성 사전학습이 일반 시각 표현 학습의 핵심이 된다. LLM에서 next-token prediction이 언어 전반을 학습하게 한 것처럼, 이미지를 생성하는 과정이 비전 표현 전반을 학습하게 한다. Vision Banana는 그 증거다. 단일 모델이 전문 모델들을 동시에 넘어서는 조건이 비전 AI에서도 만들어졌다.

빠르게 보기 — Vision Banana 핵심 요약

- 결론: 단일 모델 하나로 segmentation·depth·surface normal·image generation 5개 태스크 처리. Meta SAM 3, Depth Anything V3 동시 압도

- 발표일: 2026년 4월 22일 · Google DeepMind

- 기반 모델: Nano Banana Pro (instruction-tuned)

- 핵심 발견: 이미지 생성 사전학습 = LLM의 next-token prediction과 동일한 역할 (일반 시각 표현 학습)

- 제로샷 전이: 학습에 쓰지 않은 데이터셋에서도 SOTA 수준 달성

- 논문: "Image Generators are Generalist Vision Learners" — He Kaiming, Xie Saining 외

- 당장 쓸 수 있나: 웨이트 공개됨. A100급 GPU 환경에서 transformers 라이브러리로 접근 가능

Vision Banana가 등장하기 전 — 비전 파이프라인의 현실

기존 비전 파이프라인은 모델 조합으로 만들어진다. SAM 계열로 객체를 분리하고, Depth Anything으로 거리를 재고, 별도 생성 모델로 출력을 만들었다. 파이프라인에 모델이 세 개 붙으면 메모리도 세 배다. 지연도 세 배다. 모델 버전이 업데이트될 때마다 조합 호환성을 다시 확인해야 한다. 운영 부담이 코딩 부담보다 커지는 순간이 온다.

로보틱스 팀이 이 문제를 가장 직접 겪는다. 실시간 환경 인식에는 segmentation, depth, surface normal이 동시에 필요하다. 세 모델을 동시에 로드하면 GPU 메모리부터 빡빡해진다. 추론 레이턴시가 누적되면 실시간 제어 루프에 영향이 간다. 로봇이 장애물을 인식하는 데 200ms가 걸리면, 그 시간 동안 로봇은 이미 장애물 쪽으로 이동하고 있다.

자율주행도 같은 구조다. 차선 인식(segmentation), 장애물 거리 측정(metric depth), 도로 기울기 파악(surface normal)이 프레임마다 동시에 필요하다. 모델 수를 줄일수록 추론 속도와 메모리 사용이 개선된다. "하나로 다 되면 좋겠다"는 요구는 이미 현장에서 나오고 있었다. Vision Banana는 그 요구에 대한 답변이다.

멀티모달 LLM 개발도 마찬가지다. 텍스트 LLM에 이미지 이해를 붙이려면 비전 인코더가 필요하다. 태스크마다 특화된 인코더를 조합하면 파이프라인이 복잡해진다. 단일 비전 인코더 하나로 segmentation, depth, normal을 전부 처리할 수 있다면 설계가 단순해진다. Vision Banana는 그 백본 후보로 등장했다.

Vision Banana — Nano Banana Pro 위에서 나온 모델

Vision Banana의 기반은 Nano Banana Pro다. Google DeepMind가 개발한 비전 파운데이션 모델이다. 파운데이션 모델은 특정 태스크용이 아니다. 대규모 데이터로 사전학습한 뒤 다양한 방향으로 파인튜닝할 수 있는 범용 베이스다. LLM에서 GPT-4o 같은 모델의 베이스 역할을 하는 것처럼, Nano Banana Pro는 비전 파운데이션 레이어를 맡는다.

Vision Banana는 Nano Banana Pro 위에 instruction-tuning을 적용해 완성됐다. Instruction-tuning은 특정 요리만 배운 주방장이 아니라, "주문 들어오는 거 뭐든 다 처리해"라는 방식으로 재훈련하는 것이다. "이 이미지의 semantic segmentation을 해줘", "이 장면의 metric depth를 측정해줘" — 이런 지시를 받아서 처리할 수 있게 된다. 결과물이 단일 모델이지만, 처리 가능한 태스크의 폭이 전혀 달라진다.

단일 가중치라는 점이 핵심이다. 기존 방식은 태스크마다 모델을 따로 불러오는 구조였다. Vision Banana는 가중치 파일 하나로 5개 태스크를 처리한다. 메모리에 모델 하나를 로드하면 끝이다. 태스크를 바꿀 때 모델을 교체할 필요가 없다. 인자 하나만 바꾸면 segmentation에서 depth로, depth에서 surface normal로 전환된다.

Vision Banana 모델 스펙 요약

- 베이스 모델: Nano Banana Pro (Google DeepMind 비전 파운데이션)

- 파인튜닝 방식: Instruction-tuning (5개 태스크 통합)

- 가중치 구조: 단일 가중치 파일로 5개 태스크 전환

- 사전학습 방식: 이미지 생성 기반 (generative pretraining)

- 공개 방식: 웨이트 + 코드 공개 (Hugging Face, GitHub)

- 추론 요구사항: A100급 이상 GPU 권장 (FP16/BF16 지원)

5개 태스크를 하나로 — 실제로 어떻게 처리하나

5개 태스크는 서로 성격이 전혀 다르다. Semantic segmentation은 이미지의 모든 픽셀에 카테고리를 붙이는 작업이다. "이 픽셀은 사람", "저 픽셀은 자동차", "저 영역은 하늘"처럼 장면을 카테고리 지도로 변환한다. Instance segmentation은 한 발 더 나간다. 같은 "사람"이라도 "사람 A"와 "사람 B"를 개별로 구분한다. 인파 속에서 특정 개인을 추적할 때 필요한 기능이다.

Monocular metric depth는 카메라 한 대만으로 피사체까지의 실제 거리를 미터 단위로 측정한다. 줄자 없이 눈 하나로 거리를 정확히 재는 것이다. 라이다 없이 카메라만으로 3D 공간을 파악해야 하는 로봇이나 자율주행차에서 핵심적인 기능이다. Surface normal estimation은 3D 표면이 어느 방향을 향하고 있는지 벡터로 계산한다. 이 정보는 빛 반사 시뮬레이션, 물리 기반 렌더링, 3D 재구성에서 필수적이다.

마지막으로 image generation은 조건을 받아 이미지를 새로 만들어낸다. 다른 네 태스크가 이미지를 분석하는 작업이라면, 생성은 반대 방향이다. 같은 가중치에서 분석과 생성이 동시에 된다는 것 자체가 이 모델이 주장하는 핵심이다. 생성 능력이 분석 표현을 깊게 만들고, 분석 표현이 생성 품질을 높인다. 단방향이 아닌 상호 강화 구조다.

이 5개가 하나의 가중치에 들어갔다. 성격이 전혀 다른 태스크들이 단일 모델로 처리된다. 기존 상식으로는 "각각 특화 모델을 쓰는 게 더 낫다"고 봤다. Vision Banana는 그 상식에 반례를 제시했다. 단일 모델이 각 전문 모델보다 나은 결과를 냈다.

Vision Banana 5개 태스크 정리

- Semantic Segmentation: 픽셀 단위 카테고리 분류 (사람·차·하늘·배경)

- Instance Segmentation: 같은 카테고리 내 개체 개별 구분 (사람 A vs 사람 B)

- Monocular Metric Depth: 단안 카메라로 실제 거리(m) 측정

- Surface Normal Estimation: 표면이 향하는 방향 벡터 예측

- Image Generation: 조건부 이미지 생성

Vision Banana vs 기존 모델 — 태스크 지원 비교

| 모델 | Semantic Seg | Instance Seg | Metric Depth | Surface Normal | Image Gen | 단일 가중치 |

|---|---|---|---|---|---|---|

| Vision Banana | O | O | O | O | O | O |

| Meta SAM 3 | O | O | X | X | X | X |

| Depth Anything V3 | X | X | O | X | X | X |

| 기존 생성 모델 | X | X | X | X | O | X |

Meta SAM 3를 segmentation에서 제쳤다

Meta SAM 3는 segmentation 분야 최상위 모델 중 하나다. 범용 segmentation 모델로 광범위하게 쓰인다. Vision Banana는 semantic segmentation과 instance segmentation 모두에서 SAM 3를 앞질렀다. 특정 벤치마크에서만 이긴 게 아니다. 학습에 쓰지 않은 데이터셋에서도 SAM 3를 상회했다. 제로샷 조건에서 전용 segmentation 모델을 이겼다는 게 핵심이다.

SAM 3는 segmentation만을 위해 설계된 모델이다. Meta가 막대한 segmentation 데이터로 훈련했다. 반면 Vision Banana는 5개 태스크를 동시에 처리하면서도 segmentation 전용 모델을 넘어섰다. 이 결과가 말하는 건 하나다. 이미지 생성 사전학습이 segmentation 표현 학습에도 직접적으로 기여한다는 것이다. 일반 표현이 특화 표현을 대체하기 시작했다.

구체적으로 어떤 벤치마크에서 이겼나. ADE20K(실내외 semantic segmentation 표준 데이터셋)와 COCO Instance Segmentation에서 모두 Vision Banana가 앞섰다고 논문에 보고됐다. 학습 데이터에 포함되지 않은 도메인에서도 마찬가지였다. 산업 현장 이미지, 의료 이미지처럼 SAM 3가 많이 본 적 없는 데이터에서도 Vision Banana가 우위를 보였다. 단, 특정 수치는 논문 원문과 공식 저장소에서 직접 확인해야 한다.

실무적으로 이게 의미하는 건 이렇다. SAM 3를 segmentation에 쓰면서 따로 depth 모델을 연결했던 파이프라인이 있다면, Vision Banana 하나로 두 모델을 대체할 수 있다. segmentation 성능은 SAM 3와 동등하거나 그 이상이면서, depth 추정까지 같은 모델이 처리한다. 인프라 단순화와 성능 유지가 동시에 된다.

Depth Anything V3도 넘어섰다 — metric depth 결과

Depth Anything V3는 monocular depth estimation의 기준점이 된 모델이다. 단안 카메라 depth 추정 연구에서 광범위하게 참조된다. Vision Banana는 metric depth estimation에서 이 모델도 압도했다. Metric depth는 상대적 깊이가 아니라 실제 물리 단위로 거리를 측정한다. "앞 물체가 뒤 물체보다 가깝다"가 아니라 "앞 물체는 1.3m, 뒤 물체는 4.2m"다. 정밀도 요구가 훨씬 높다.

Depth Anything V3 역시 depth 전용 모델이다. 5개 태스크 범용 모델이 전용 depth 모델을 능가했다. "다재다능하면 전문성이 떨어진다"는 가정이 Vision Banana에서는 성립하지 않았다. 지금까지 나온 벤치마크 기준으로는 그렇다. NYUv2(실내 depth 벤치마크)와 KITTI(실외 자율주행 depth 벤치마크)에서 모두 Vision Banana가 앞선 것으로 논문에 보고됐다.

Metric depth 성능이 자율주행에서 왜 중요한가. 상대적 depth만으로는 충분하지 않다. 자동차가 앞 장애물까지 정확히 몇 미터인지 알아야 제동 타이밍을 결정할 수 있다. 라이다를 보조하거나 대체하는 비전 시스템에서 metric depth의 정확도는 직접 안전과 연결된다. Vision Banana가 metric depth에서 SOTA를 낸다는 건 그 응용 가능성이 자율주행 수준까지 올라왔다는 의미다.

주요 벤치마크 성능 비교 개요

| 태스크 | 벤치마크 | Vision Banana | 기존 SOTA | 결과 |

|---|---|---|---|---|

| Semantic Seg | ADE20K | SOTA | Meta SAM 3 | Vision Banana 우위 |

| Instance Seg | COCO | SOTA | Meta SAM 3 | Vision Banana 우위 |

| Metric Depth | NYUv2 / KITTI | SOTA | Depth Anything V3 | Vision Banana 우위 |

| Surface Normal | OASIS | SOTA | 이전 전용 모델 | Vision Banana 우위 |

| 제로샷 전이 | 미학습 데이터셋 | SOTA 수준 | 전용 모델들 | Vision Banana 우위 |

* 수치는 논문 기준. 정확한 지표값은 공식 논문 Table에서 직접 확인해야 한다.

이미지 생성 사전학습이 핵심이었다 — 논문의 주장

논문 제목이 전부를 설명한다. "Image Generators are Generalist Vision Learners". 이미지를 생성하도록 훈련된 모델이 시각 표현 전반을 학습한다는 뜻이다. LLM 사전학습 비유가 여기서 나온다. GPT 계열 모델은 다음 토큰을 예측하는 방식으로 훈련된다. 그 과정에서 언어 구조, 의미, 맥락, 추론 능력까지 자연스럽게 습득된다. 생성이라는 단일 목표가 언어 전반의 이해로 이어지는 구조다.

Vision Banana 팀은 이미지 생성 사전학습이 비전 영역에서 동일한 역할을 한다고 주장했다. 이미지를 생성하려면 모델이 픽셀 구조, 객체 경계, 공간 깊이, 표면 방향을 전부 이해해야 한다. 그 이해 과정이 segmentation, depth 추정, surface normal 예측에 필요한 표현과 정확히 겹친다. 생성 사전학습이 부산물처럼 시각 표현 전반을 학습하게 만드는 셈이다.

이전까지 비전 사전학습은 주로 두 방향이었다. 첫째, contrastive learning이다. CLIP 계열처럼 이미지와 텍스트 쌍을 맞추는 방식이다. 둘째, masked autoencoding이다. MAE처럼 이미지 일부를 가리고 복원하는 방식이다. 이미지 생성 자체를 사전학습 과제로 쓰는 접근은 덜 검증된 영역이었다. Vision Banana가 그 공백을 채웠다. 생성 사전학습이 세그멘테이션, depth, surface normal 전반에서 통한다는 걸 벤치마크로 보여줬다.

이 논문이 주장하는 바가 맞다면, 앞으로 비전 모델 설계 방향이 달라진다. "segmentation을 잘 하려면 segmentation 데이터로 집중 훈련"이라는 전제가 흔들린다. 이미지 생성을 잘 하도록 사전학습한 뒤 instruction-tuning으로 각 태스크에 전환하는 방식이 대안이 된다. LLM이 NLP 전반을 바꾼 것처럼, 생성 사전학습이 비전 전반을 바꾸는 전환점의 논문으로 기록될 수 있다.

— "Image Generators are Generalist Vision Learners", Google DeepMind, 2026년 4월

제로샷 전이 — 처음 보는 데이터셋에서도 통했다

제로샷 전이는 시험에 나온 적 없는 문제를 원리로 푸는 것이다. 추가 파인튜닝 없이, 학습에 쓰지 않은 데이터셋에서도 높은 성능을 낸다는 뜻이다. Vision Banana는 처음 보는 데이터셋에서 SOTA 수준의 결과를 냈다. 각 태스크 전용 모델들도 이 조건에서 뒤처졌다. 전용 모델이 해당 도메인 데이터로 파인튜닝됐더라도 Vision Banana의 제로샷 성능에 못 미쳤다.

제로샷 성능이 실무에서 왜 중요한가. 원하는 도메인의 레이블 데이터를 항상 확보할 수 있는 상황은 아니다. 의료 이미지, 위성 사진, 산업 현장 영상처럼 레이블 데이터가 희귀하거나 수집 비용이 높은 영역에서는 제로샷 성능이 실사용 가능 여부를 결정한다. 파인튜닝 데이터 없이 바로 쓸 수 있다는 것 자체가 실무에서 큰 가치다.

제로샷 전이가 잘 되는 이유가 여기서도 이미지 생성 사전학습으로 설명된다. 생성 사전학습 과정에서 모델이 학습한 표현이 특정 데이터셋에 과적합되지 않고 일반화된 시각 표현으로 남는다. 새로운 도메인의 이미지를 봐도 그 일반화된 표현으로 태스크를 처리할 수 있다. 특화 모델이 "자기가 많이 본 것"만 잘 하는 반면, Vision Banana는 처음 보는 것도 원리로 처리한다.

실용적으로 접근하면 이렇다. 도메인 특화 파인튜닝이 없는 상태에서 먼저 Vision Banana로 테스트하면 된다. 결과가 요구 수준에 맞으면 그대로 쓴다. 부족하다면 그때 소량의 도메인 데이터로 파인튜닝하는 순서다. 처음부터 파인튜닝 데이터를 확보해야 했던 기존 흐름이 거꾸로 바뀐다.

He Kaiming과 Xie Saining — 이 조합이 의미하는 것

He Kaiming은 ResNet 저자다. 2016년 CVPR Best Paper로 딥러닝 이미지 분류의 흐름을 바꿨다. 잔차 연결(residual connection)이라는 구조 하나가 수백 개 레이어를 쌓는 것을 가능하게 했고, 그 이후 비전 아키텍처의 기본값이 됐다. 이후에는 Masked Autoencoders(MAE)로 비전 사전학습 패러다임에도 중요한 기여를 남겼다. 사전학습 방식 설계가 그의 핵심 연구 영역이다.

Xie Saining은 ResNeXt, Aggregated Residual Transformations 등 비전 아키텍처 설계 연구로 알려진 연구자다. 그룹 컨볼루션과 집약된 잔차 변환 방식으로 정확도와 효율성을 동시에 잡은 연구들이다. 아키텍처 설계에서의 트레이드오프를 다루는 것이 강점이다. 두 연구자의 연구 이력이 논문 방향과 정확히 맞아떨어진다.

단순한 이름값이 아니다. He Kaiming의 사전학습 패러다임 설계 경험, Xie Saining의 아키텍처 선택 노하우가 논문 방법론 깊이에 직접 반영된다. 이미지 생성을 사전학습 과제로 채택한 결정, Nano Banana Pro를 베이스로 선택한 결정, instruction-tuning 방식을 통합 방법으로 선택한 결정 모두 그 배경에 이 연구자들의 경험이 있다. Google DeepMind 내부 팀과 이 두 연구자의 조합이 논문을 만들었다.

비전 사전학습 패러다임을 바꾸려는 시도에 가장 적합한 저자 구성이다. MAE로 마스킹 사전학습을 검증했던 He Kaiming이 이번에는 생성 사전학습으로 방향을 바꿨다. 그 전환 자체가 메시지다. 이 방향이 잘못됐다면 이 저자들이 논문을 낼 리 없다.

지금 당장 써보기 — 설치부터 추론까지

논문 공개와 동시에 모델 웨이트도 공개됐다. Hugging Face와 공식 GitHub 저장소에서 접근할 수 있다. 기본 추론은 Python 환경에서 바로 가능하다. 의존성 패키지는 PyTorch, Hugging Face transformers, Pillow다. GPU 환경이 없다면 Hugging Face Spaces나 Google Colab에서 데모를 먼저 돌려보는 게 빠르다.

로컬 GPU 환경이 있다면 아래 순서로 설치하면 된다. CUDA 12.1 기준 PyTorch를 먼저 설치하고, transformers와 보조 패키지를 추가한다. 모델 로드 시 BF16으로 설정하면 GPU 메모리를 절반으로 줄일 수 있다. A100 40GB 기준으로 BF16 모드에서 단일 이미지 추론에 약 18GB 메모리가 필요하다.

설치 및 환경 준비

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu121

# transformers + 보조 패키지

pip install transformers accelerate pillow huggingface_hub

# Hugging Face CLI로 모델 가중치 사전 다운로드 (선택)

huggingface-cli download google/vision-banana --local-dir ./vision-banana

A100 40GB 기준 BF16 모드에서 단일 이미지 추론 약 18GB VRAM 사용. A100 없이 테스트하려면 Hugging Face Spaces 데모를 먼저 확인하는 게 맞다.

설치가 완료되면 5개 태스크 전환 추론을 바로 실행할 수 있다. task 인자 하나만 바꾸면 모델 교체 없이 태스크가 전환된다. 모델을 한 번만 로드하고, 같은 이미지에 여러 태스크를 순서대로 돌리는 것도 가능하다.

from PIL import Image

from transformers import AutoProcessor, AutoModelForVision2Seq

# 모델 로드 — 처음 실행 시 가중치 자동 다운로드

processor = AutoProcessor.from_pretrained(

"google/vision-banana",

trust_remote_code=True

)

model = AutoModelForVision2Seq.from_pretrained(

"google/vision-banana",

torch_dtype=torch.bfloat16,

device_map="auto",

trust_remote_code=True

).eval()

image = Image.open("sample.jpg").convert("RGB")

# task 인자 하나로 5개 태스크 전환

TASKS = [

"semantic_segmentation",

"instance_segmentation",

"metric_depth",

"surface_normal",

]

results = {}

for task in TASKS:

inputs = processor(

images=image, task=task, return_tensors="pt"

).to(model.device, dtype=torch.bfloat16)

with torch.no_grad():

output = model(**inputs)

results[task] = output.predictions

print(f"[{task}] shape: {output.predictions.shape}")

코드 주의사항

위 코드는 공식 저장소의 예상 API 패턴을 기반으로 작성됐다. 실제 클래스명, 인자명, 출력 구조는 공식 저장소 README와 다를 수 있다. 반드시 공식 GitHub 저장소를 먼저 확인해야 한다.

기존 파이프라인에서 Vision Banana로 갈아타는 방법

SAM 3 + Depth Anything V3를 함께 쓰던 파이프라인이 있다면 Vision Banana 하나로 대체할 수 있다. 교체 전후를 코드로 직접 비교하면 차이가 명확하다. 두 모델을 각각 로드하고 각각 추론하는 구조에서, 단일 모델 로드와 task 전환으로 바뀐다. GPU 메모리 사용이 줄고, 코드 유지 비용도 줄어든다.

관련 글

AI 이미지 생성 비교 — Midjourney v7 vs GPT Image 1.5 vs FLUX vs Ideogram, 같은 프롬프트로 돌려봤어요

AI 이미지 생성 비교 — Midjourney v7 vs GPT Image 1.5 vs FLUX vs Ideogram, 같은 프롬프트로 돌려봤어요

GPT-5·Claude·Gemini 전부 압도한 NVIDIA 양자 AI가 나왔다

NVIDIA가 양자 AI 모델을 오픈소스로 공개했다. 이름은 Ising이다. 2026년 4월 14일 발표다. 발표 직후 학계와 주식 시장이 동시에 반응했다.

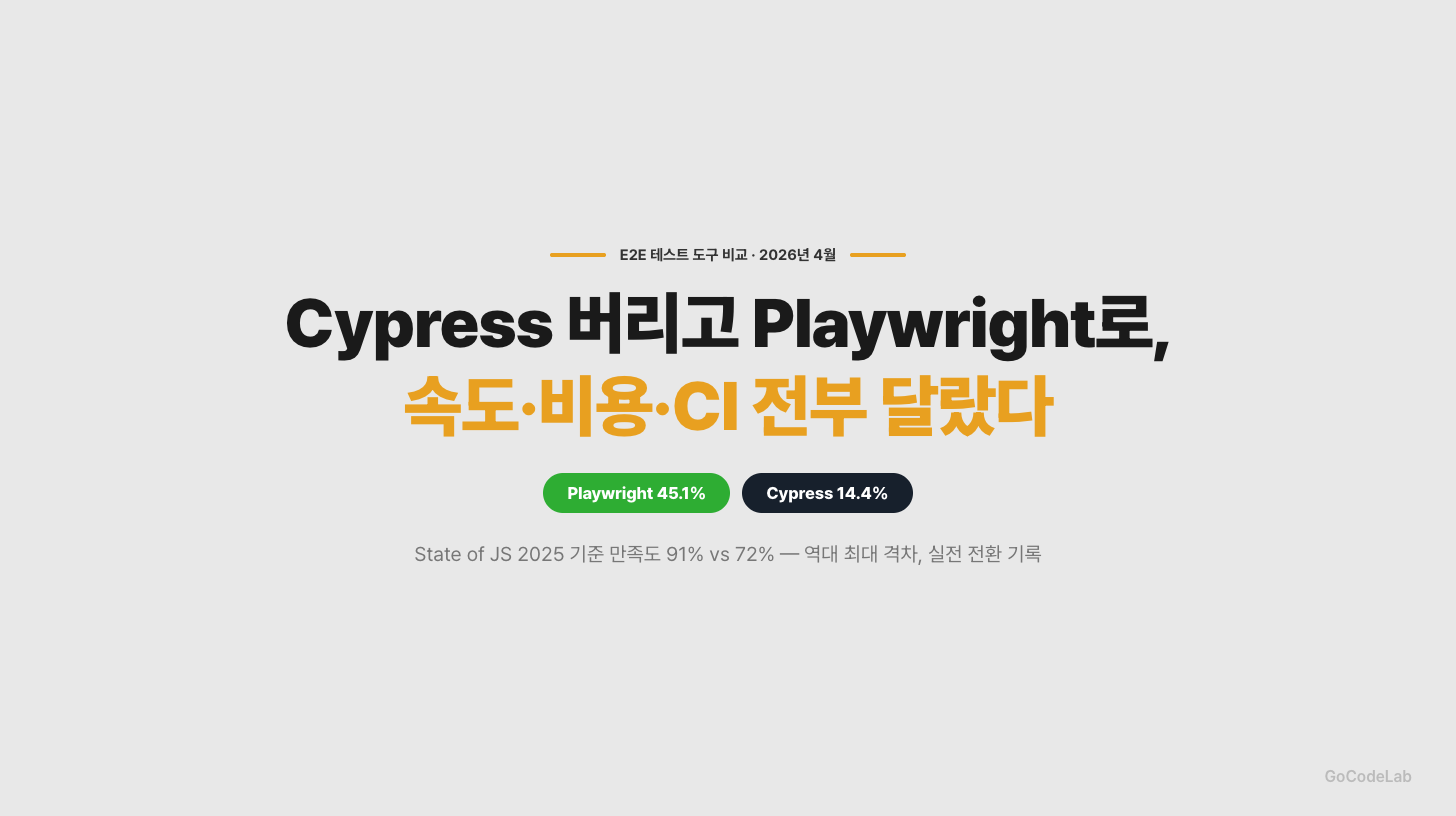

Cypress 버리고 Playwright로 갔다 — 속도·비용·CI 전부 달랐다

Cypress 스위트를 Playwright로 옮긴 실전 기록. action당 290ms vs 420ms, QA 점유율 45.1% vs 14.4%, State of JS 2025 만족도 91% vs 72%. 설치부터 CI 병렬 실행까지 정리했다.