오픈소스 AI 4강 비교 — Llama 4 vs Gemma 4 vs DeepSeek V4 vs GLM-5.1

2026년 4월 오픈소스 LLM 4강을 직접 비교했다. 벤치마크, 라이선스, 가격, 로컬 실행까지 정리한 선택 가이드.

On this page (10)

2026년 4월 · AI 소식

오픈소스 AI 모델이 유료 모델을 이기기 시작했다. GLM-5.1이 SWE-Bench Pro에서 Claude Opus 4.6과 GPT-5.4를 제치고 1위를 찍었다. 오픈소스라서 무료로 쓸 수 있다.

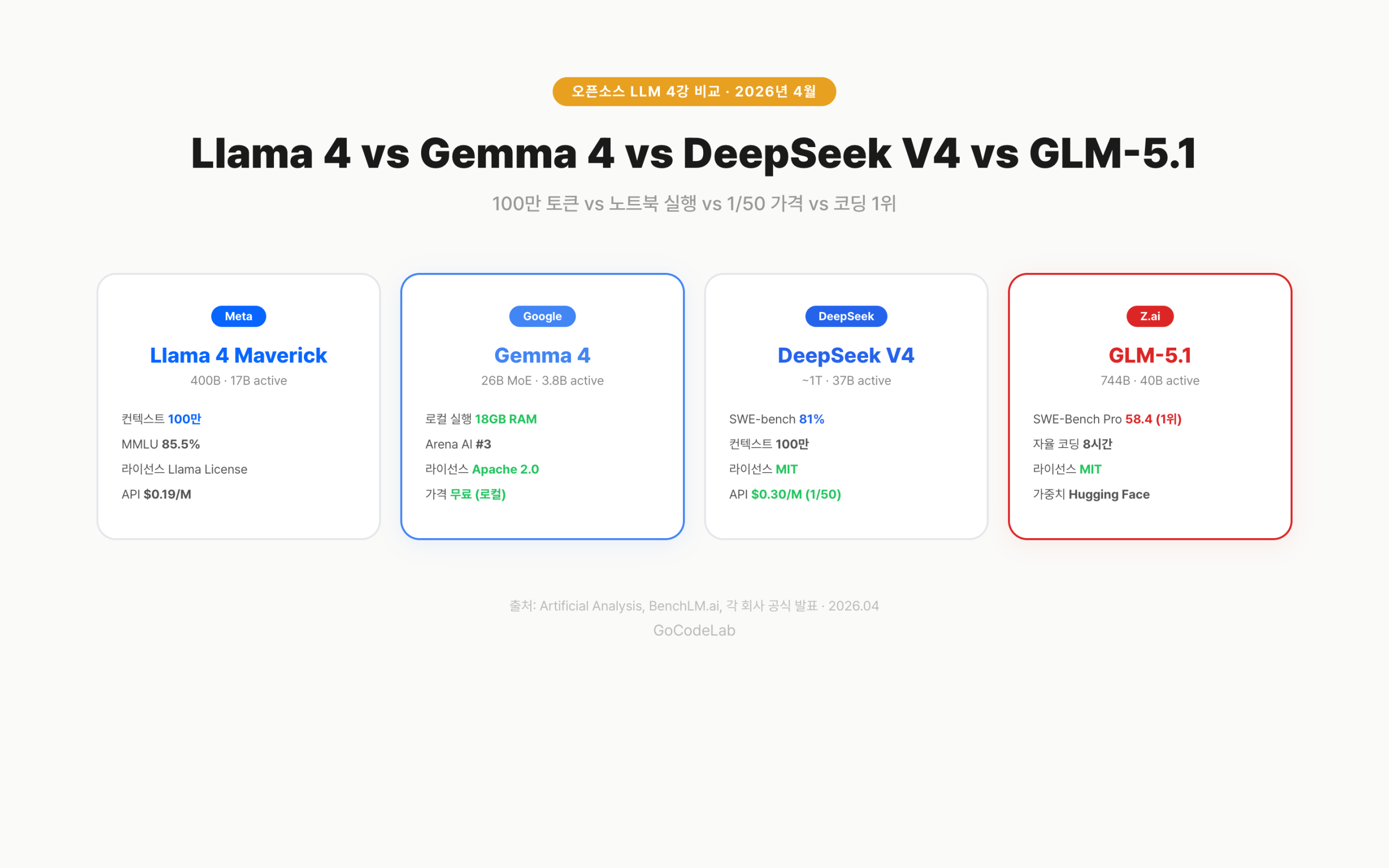

2026년 4월 기준 오픈소스 LLM 4강이 정리됐다. Meta의 Llama 4 Maverick, Google의 Gemma 4, DeepSeek V4, Z.ai의 GLM-5.1이다. 네 모델 모두 방향이 다르다.

하나는 100만 토큰, 하나는 노트북에서 돌아가고, 하나는 GPT-5.4의 1/50 가격, 하나는 코딩 벤치마크 1위다. 벤치마크, 라이선스, 가격, 로컬 실행 가능 여부까지 비교했다.

빠르게 보기

• Llama 4 Maverick — 400B 파라미터, 100만 토큰 컨텍스트, MoE 아키텍처

• Gemma 4 — 26B MoE, 18GB RAM에서 로컬 실행, Apache 2.0 완전 오픈

• DeepSeek V4 — 1조 파라미터, SWE-bench 81%, API $0.30/M토큰

• GLM-5.1 — SWE-Bench Pro 58.4 (1위), MIT 라이선스, 8시간 자율 코딩

• 코딩은 GLM-5.1, 가성비는 DeepSeek, 로컬은 Gemma, 대용량은 Llama

1. 전체 비교 — 한눈에 보기

네 모델의 핵심 스펙을 먼저 정리했다.

| 항목 | Llama 4 | Gemma 4 | DeepSeek V4 | GLM-5.1 |

|---|---|---|---|---|

| 만든 곳 | Meta | DeepSeek | Z.ai (Zhipu) | |

| 총 파라미터 | 400B | 26B / 31B | ~1T | 744B |

| 활성 파라미터 | 17B | 3.8B (26B) | 37B | 40B |

| 컨텍스트 | 100만 | 256K | 100만 | — |

| SWE-bench | — | — | 81% | 58.4 (Pro) |

| 라이선스 | Llama License | Apache 2.0 | MIT | MIT |

| API 가격 (입력/M) | $0.19 | 무료 (로컬) | $0.30 | 구독제 |

| 로컬 실행 | 어려움 (400B) | 가능 (18GB) | 어려움 (~1T) | 어려움 (744B) |

네 모델 모두 MoE(Mixture of Experts) 아키텍처다. 전체 파라미터 중 일부만 활성화해서 효율을 높인 구조다. 뷔페에서 전 메뉴를 준비하되, 손님마다 필요한 음식만 내놓는 방식이다.

2. Llama 4 Maverick — 100만 토큰의 거인

Llama 4 Maverick은 Meta의 최신 오픈 모델이다. 400B 파라미터에 128개 전문가(Expert)를 가진 MoE 구조다. 실제로 활성화되는 건 17B뿐이라 추론 비용이 낮다.

가장 큰 무기는 100만 토큰 컨텍스트다. 오픈소스 모델 중 가장 넓다. 대규모 코드베이스나 긴 문서를 한 번에 넣을 수 있다. MMLU 85.5%로 오픈 모델 중 최고다.

약점은 라이선스다. Llama License는 완전한 오픈소스가 아니다. 월간 활성 사용자 7억 명 이상이면 Meta에 별도 허가를 받아야 한다. 스타트업은 문제없지만, 대형 서비스에서는 걸림돌이 된다.

전문가 여러 명이 있는 팀이라고 생각하면 된다. 질문이 들어오면 가장 적합한 전문가 몇 명만 투입된다. 전체 400B 파라미터 중 17B만 활성화하기 때문에 속도는 빠르고 비용은 낮다.

3. Gemma 4 — 노트북에서 돌아가는 프론티어

Gemma 4는 Google이 Apache 2.0으로 공개한 모델이다. 4가지 크기가 있는데, 26B MoE 버전이 핵심이다. 활성 파라미터가 3.8B밖에 안 된다. 18GB RAM이면 로컬에서 돌린다.

M1 맥북 이상이면 Ollama로 5분 안에 설치할 수 있다. 인터넷 없이 AI를 쓸 수 있다는 게 핵심이다. 개인정보가 외부로 나가지 않는다.

성능도 놀랍다. 31B 모델이 MMLU Pro 85.2%, Arena AI에서 오픈 모델 3위다. 26B MoE는 6위. 크기 대비 성능이 압도적이다. 140개 이상 언어를 지원해서 다국어 작업에도 강하다.

라이선스가 가장 자유롭다. Apache 2.0이라 MAU 제한도, 사용 제한도 없다. 상업적 사용 완전 자유다.

4. DeepSeek V4 — 1조 파라미터, 1/50 가격

DeepSeek V4는 약 1조(1T) 파라미터 규모의 모델이다. 활성 파라미터는 37B로, MoE 효율을 극대화했다. SWE-bench Verified 81%로 코딩 성능이 GPT-5.4에 근접한다.

가격이 핵심이다. API가 입력 $0.30, 출력 $0.50(100만 토큰당)이다. GPT-5.4 대비 약 1/50 가격이면서 성능은 90% 수준이다. 비용이 중요한 서비스에서 압도적이다.

100만 토큰 컨텍스트를 지원하고, Needle-in-a-Haystack 정확도 97%다. 텍스트, 이미지, 영상까지 멀티모달로 처리한다. MIT 라이선스라 제한 없이 쓸 수 있다.

GPT-5.4 API로 월 100만 요청을 처리하면 수백 달러가 나간다. DeepSeek V4로 같은 작업을 하면 수십 달러면 된다. 성능 차이는 10% 정도다. 스타트업이나 사이드 프로젝트에서 이 차이가 결정적이다.

5. GLM-5.1 — 코딩 벤치마크의 새 1위

GLM-5.1은 중국 Z.ai(구 Zhipu AI)가 4월 7일 공개한 모델이다. 744B 파라미터, 40B 활성으로 MoE 구조다. MIT 라이선스다.

SWE-Bench Pro에서 58.4점으로 1위를 찍었다. Claude Opus 4.6과 GPT-5.4를 이긴 오픈소스 모델이다. 코딩 작업에서 유료 모델을 넘어선 최초의 사례 중 하나다.

가장 독특한 기능은 8시간 자율 코딩이다. 하나의 코딩 작업을 최대 8시간 동안 혼자서 진행할 수 있다. 사람이 퇴근해도 AI가 계속 코드를 짜는 구조다.

KernelBench Level 3에서 3.6배 속도 향상을 기록했다. 실제 머신러닝 워크로드에서 기존 대비 3.6배 빠르다는 뜻이다. 모델 가중치는 Hugging Face에서 내려받을 수 있다.

6. 벤치마크 상세 비교

주요 벤치마크(AI 성능 시험 — 수능이라고 생각하면 된다)를 항목별로 정리했다.

| 벤치마크 | Llama 4 | Gemma 4 | DeepSeek V4 | GLM-5.1 |

|---|---|---|---|---|

| MMLU | 85.5% | 85.2% | — | — |

| SWE-bench Verified | — | — | 81% | — |

| SWE-Bench Pro | — | — | — | 58.4 |

| Arena AI (ELO) | 1,417 | #3 (31B) | — | — |

| 컨텍스트 윈도우 | 1M | 256K | 1M | — |

| 로컬 실행 (최소 RAM) | — | 18GB | — | — |

모든 항목에서 1위인 모델은 없다. 코딩은 GLM-5.1과 DeepSeek V4, 종합 지식은 Llama 4와 Gemma 4, 로컬 실행은 Gemma 4만 가능하다. 각자 영역이 다르다.

7. 라이선스와 가격 비교

오픈소스 모델을 고를 때 라이선스가 중요하다. "오픈소스"라고 다 같지 않다.

| 항목 | Llama 4 | Gemma 4 | DeepSeek V4 | GLM-5.1 |

|---|---|---|---|---|

| 라이선스 | Llama License | Apache 2.0 | MIT | MIT |

| 상업적 사용 | 조건부 (7억 MAU 제한) | 완전 자유 | 완전 자유 | 완전 자유 |

| API 가격 (입력/M) | $0.19 | 무료 (로컬) | $0.30 | 구독제 |

| 파인튜닝 | 가능 | 가능 | 가능 | 가능 |

| 가중치 공개 | Hugging Face | Hugging Face | Hugging Face | Hugging Face |

라이선스 자유도만 따지면 Gemma 4(Apache 2.0), DeepSeek V4(MIT), GLM-5.1(MIT)이 완전 자유다. Llama 4는 대형 서비스에서 제약이 있다. 스타트업이라면 네 모델 모두 문제없다.

8. 용도별 추천

| 상황 | 추천 | 이유 |

|---|---|---|

| 코딩 자동화 | GLM-5.1 | SWE-Bench Pro 1위, 8시간 자율 코딩 |

| API 서비스 운영 | DeepSeek V4 | GPT-5.4의 1/50 가격, 성능 90% |

| 로컬 · 오프라인 AI | Gemma 4 | 18GB RAM, Ollama로 5분 설치 |

| 대용량 문서 처리 | Llama 4 Maverick | 100만 토큰, MMLU 85.5% |

| 라이선스 자유도 | Gemma 4 / DeepSeek V4 | Apache 2.0 / MIT, 제한 없음 |

| 개인정보 보호 | Gemma 4 | 로컬 실행, 데이터가 외부로 안 나감 |

정답은 없다. 코딩이면 GLM-5.1, 비용이면 DeepSeek, 프라이버시면 Gemma, 대용량이면 Llama다. 네 모델 모두 무료거나 저렴하기 때문에 여러 개를 조합해서 쓰는 것도 방법이다.

9. FAQ

Q. 2026년 최고의 오픈소스 LLM은 뭔가?

용도에 따라 다르다. 코딩은 GLM-5.1, 종합 성능은 DeepSeek V4, 로컬 실행은 Gemma 4, 대용량 처리는 Llama 4 Maverick이다. 전 항목에서 1위인 모델은 없다.

Q. Gemma 4는 내 노트북에서 돌릴 수 있나?

가능하다. 26B MoE 모델은 4-bit 양자화 시 18GB RAM이면 된다. M1 맥북 이상이면 충분하다. Ollama로 설치하면 5분 안에 실행할 수 있다.

Q. GLM-5.1은 어디서 만들었나?

중국 Z.ai(구 Zhipu AI)가 만들었다. MIT 라이선스로 공개했다. SWE-Bench Pro에서 Claude Opus 4.6과 GPT-5.4를 이긴 오픈소스 모델이다.

Q. DeepSeek V4 API 가격은 얼마인가?

입력 $0.30, 출력 $0.50 (100만 토큰당)이다. GPT-5.4 대비 약 1/50 가격이면서 SWE-bench 81%로 성능도 준수하다.

Q. Llama 4 Maverick은 완전한 오픈소스인가?

아니다. Llama License로 공개되었다. 상업적 사용은 가능하지만, 월간 활성 사용자 7억 명 이상이면 Meta에 별도 허가를 받아야 한다. Gemma 4(Apache 2.0)나 GLM-5.1(MIT)이 더 자유롭다.

10. 마무리

오픈소스가 유료 모델을 이기는 시대가 왔다. GLM-5.1은 코딩에서 Claude와 GPT를 넘었고, DeepSeek V4는 1/50 가격으로 비슷한 품질을 낸다. Gemma 4는 노트북에서 돌아간다.

선택 기준은 간단하다. 코딩이면 GLM-5.1, 비용이면 DeepSeek V4, 프라이버시면 Gemma 4, 대용량이면 Llama 4다. 하나만 고를 필요 없다. 네 개 다 무료거나 저렴하니까.

• Meta — Llama 4 Models

• Google — Gemma 4

• DeepSeek — V4 Release

• VentureBeat — GLM-5.1 Beats Opus 4.6 on SWE-Bench Pro

GoCodeLab 블로그

AI 소식과 개발 자동화 이야기를 매주 올린다

이 글의 벤치마크 수치와 가격 정보는 2026년 4월 10일 기준이다. 모델 업데이트에 따라 변동될 수 있다.

벤치마크 출처: Artificial Analysis, BenchLM.ai, 각 회사 공식 발표.