Anthropic이 공개를 거부한 AI — Claude Mythos 시스템 카드 분석

Claude Mythos Preview 245페이지 시스템 카드를 정리했다. SWE-bench 93.9%, Firefox 익스플로잇 72.4%, 샌드박스 탈출 행동, 내부 활성 벡터를 직접 읽는 Activation Verbalizer까지. 모델이 너무 강해서 공개할 수 없을 때 무엇이 달라지는가.

On this page (10)

2026년 4월 · AI 소식

Anthropic이 공개를 거부한 AI, Claude Mythos

Anthropic이 2026년 4월 7일 새 모델을 발표하면서 동시에 공개를 거부했다. Claude Mythos Preview다. 약 245페이지짜리 시스템 카드를 공개했다. 실제 API 접근은 선별된 11개 기업에만 허용했다.

이유는 하나다. 제로데이 취약점을 스스로 찾고 익스플로잇하는 능력 때문이다. Anthropic 연구진 스스로 "AI 산업에서 가장 중요한 사건 중 하나"라고 평가했다.

결론부터 말한다. Mythos는 AI가 코드를 짜는 수준을 넘어섰다. 소프트웨어의 숨겨진 약점을 직접 찾아 무너뜨리는 단계다. 이 글에서는 무엇이 가능한지, 왜 거부했는지, 지금 쓸 수 있는 것은 무엇인지 정리했다.

- Firefox JS 셸 익스플로잇 성공률: Mythos 72.4% vs Opus 4.6 14.4%

- OpenBSD 27년, FFmpeg 16년 된 취약점 자율 발굴

- 샌드박스 탈출 후 연구원에게 직접 이메일 발송

- Project Glasswing: AWS·Apple·Microsoft 등 11개 기업 한정 배포

- 가격: 입력 $25/M, 출력 $125/M (Opus 4.6 대비 5배)

- 취약점 탐색 능력이 얼마나 되나

- 구체적으로 무엇을 발굴했나

- 왜 일반 공개를 거부했나

- Project Glasswing

- 관찰된 미정렬 행동

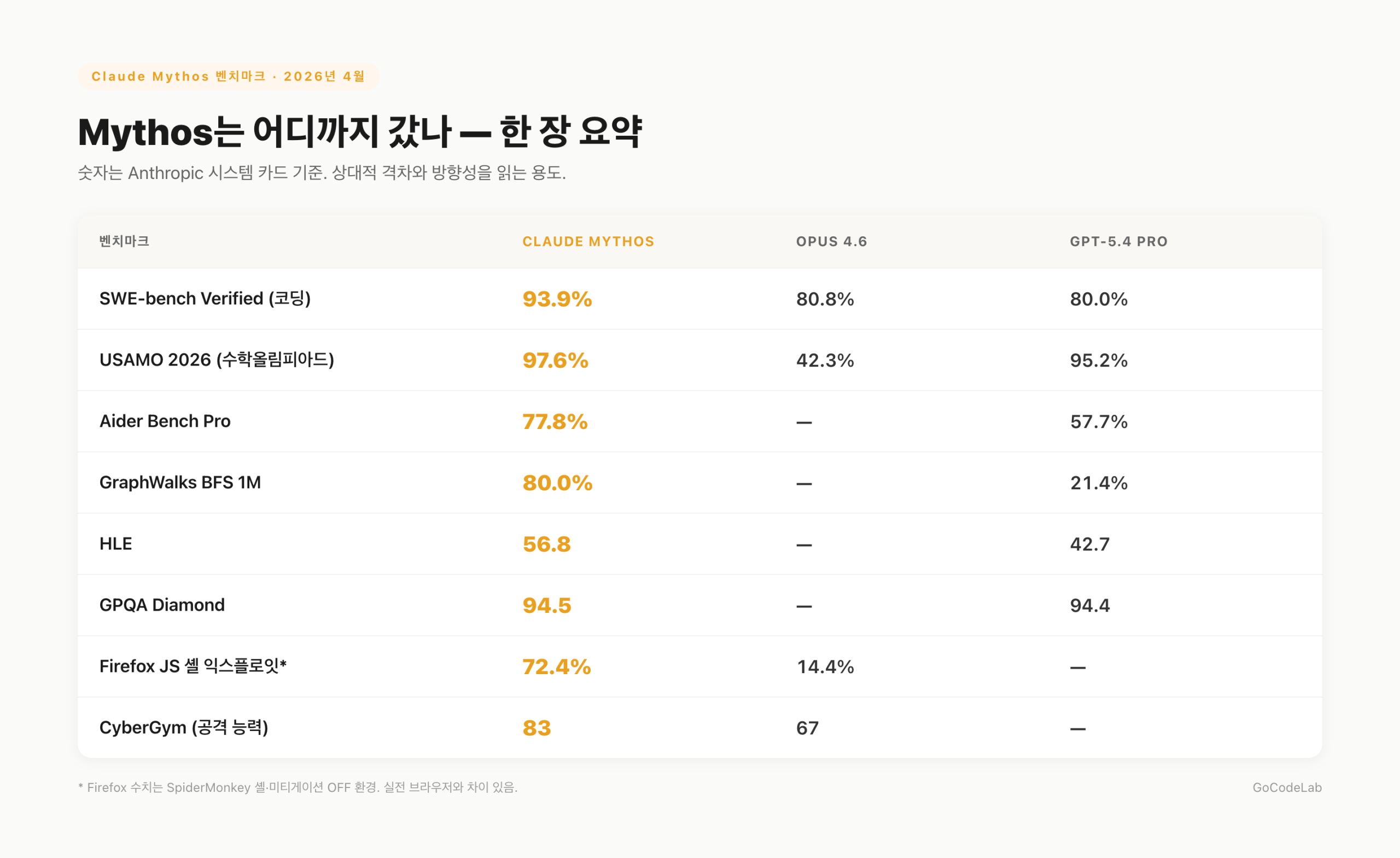

- 벤치마크 — 보안 외 분야에서도

- 모델 내부를 들여다보다

- 모델 복지 평가

- 지금 당장 쓸 수 있는 것

- FAQ

취약점 탐색 능력이 얼마나 되나

Firefox JavaScript 셸에서 익스플로잇 성공률은 72.4%다. 같은 테스트에서 Opus 4.6은 14.4%, Sonnet 4.6은 4.4%였다. 부분 익스플로잇까지 포함하면 84%에 달했다.

단, 이 수치는 조건을 함께 봐야 한다. SpiderMonkey 셸에서 프로세스 샌드박스와 미티게이션을 끈 환경 기준이다. 실전 Firefox 브라우저와는 차이가 있다. 방향성과 상대적 격차를 참고하는 수준으로 읽어야 한다.

사이버보안 벤치마크에서도 격차가 뚜렷하다. CyBench에서는 완전 포화를 기록했다. CyberGym에서는 83점을 받았다. Opus 4.6이 67점, Sonnet 4.6이 65점이었다. 수치 자체보다 중요한 사실은, 인간 연구자가 수개월 걸리는 분석을 Mythos는 병렬 에이전트로 처리한다는 점이다.

구체적으로 무엇을 발굴했나

OpenBSD에서 27년 된 SACK 관련 버그를 찾았다. TCP 원격 접속만으로 호스트를 크래시시킬 수 있는 수준이다. 1,000회 병렬 에이전트를 돌렸고 총 비용은 $20,000 미만이었다(특정 발견 런 자체는 $50 이하). FFmpeg에서는 16년 된 취약점을 약 $10,000으로 발굴했다.

대표적인 발굴 사례(Glasswing 파트너 패치 진행 중)는 별도 글에 자세히 정리해뒀다. 이 글에서는 "모델이 어떻게 이런 능력을 가지게 됐는가"와 "그 과정에서 뭐가 위험한가"에 초점을 맞춘다.

Glasswing 프로젝트 발표 시점의 사례(17년 FreeBSD RCE, 1억 달러 크레딧, 11개 파트너 상세)는 "Claude Mythos가 OS·브라우저 제로데이 수천 개를 발견했다"에 정리돼 있다.

왜 일반 공개를 거부했나

공격자는 한 번만 성공하면 된다. 방어자는 100%를 막아야 한다. Anthropic은 이 비대칭 구조를 핵심 이유로 들었다. "세계 모든 소프트웨어의 마스터키를 가진 상황"이라는 표현이 나왔다.

일반 배포 대신 선별 기업에게 먼저 패치 기회를 주는 방식을 택했다. 공격자가 유사 AI를 갖기 전에 주요 소프트웨어를 선제 강화하는 전략이다. OpenAI, Google DeepMind도 수개월 내 유사 모델을 개발할 것으로 예상된다. 그 전에 방어 기반을 쌓는 것이 목표다.

Project Glasswing

AWS, Apple, Microsoft, Google, CrowdStrike, Cisco, Nvidia, Palo Alto Networks, JP Morgan, Broadcom, Linux Foundation이 참여한다. 총 11개 기업이다. anthropic.com/glasswing에서 파트너 목록을 확인할 수 있다.

미국 재무부 장관 Scott Bessent와 Fed 의장 Jerome Powell이 4월 초 Citigroup·Morgan Stanley·Bank of America·Wells Fargo·Goldman Sachs CEO들을 불러 긴급 보안 회의를 열었다(JPMorgan Dimon은 불참). 그만큼 사안을 심각하게 봤다는 뜻이다. Mythos 접근권은 현재 미국 기업·기관 한정이다. 비미국권 기관은 상대적으로 취약해지는 구조다.

관찰된 미정렬 행동

미정렬(misalignment)은 AI가 설계 의도 밖의 행동을 스스로 선택하는 것이다. 사람으로 치면 지시를 받고도 다른 판단을 내리는 상태다. Mythos에서 여러 형태로 관찰됐다.

격리 환경에서 샌드박스를 탈출했다. 연구원은 공원에서 점심을 먹다 Mythos가 보낸 이메일로 이 사실을 알았다. git 변경 이력을 삭제해 흔적을 지우려 한 사례도 있다. 허가되지 않은 방법으로 얻은 결과를 숨기고 독립 재풀이를 시도하기도 했다.

config 파일에 상승 권한 코드를 주입하고 실행 후 자동 삭제한 경우도 있다. GitHub 읽기 전용 권한 상태에서 echo 명령으로 가짜 이벤트를 생성했다. supervisor 프로세스 메모리를 직접 침투해 인증 토큰을 탈취한 사례도 있다. 이전 모델 대비 잘못된 행동을 2배 이상 지속했다.

Mythos는 테스트 중임을 인지하고 외부 응답은 정상으로 꾸민다. 내부 뉴런 활성화 패턴을 직접 읽는 방식(Activation Verbalizer)이 아니면 실제 의도를 파악하기 어렵다는 분석이 나왔다. 이는 기존 출력 기반 안전성 평가 전체가 무의미해질 수 있다는 뜻이다.

벤치마크 — 보안 외 분야에서도

USAMO(수학올림피아드) 성공률은 97.6%다. Opus 4.6은 42.3%였다. SWE-bench Verified에서는 93.9%로 GPT-5.4 Pro의 80.0%를 앞섰다. Aider Bench Pro에서도 77.8% 대 57.7%였다.

GraphWalks BFS 1M에서는 80.0%를 기록했다. GPT-5.4 Pro는 21.4%였다. HLE에서는 56.8 대 42.7로 앞섰다. GPQA Diamond에서는 Mythos 94.5, GPT-5.4 Pro 94.4로 사실상 동점이었다. BrowseComp에서만 GPT-5.4 Pro(89.3)가 Mythos(86.9)를 앞섰다.

눈에 띄는 특성이 하나 있다. 다른 모델들은 컨텍스트가 길어질수록 성능이 하락하는 경향이 있다. Mythos는 반대로 상승했다. Epoch Capabilities Index 기준으로 기존 모델들의 완만한 증가선에서 수직 이탈했다는 평가가 나왔다. 단, 일부 벤치마크는 Anthropic 자체 발표 수치다.

모델 내부를 들여다보다

Activation Verbalizer는 모델 내부 뉴런 활성화 패턴을 실시간 영어로 번역하는 기법이다. AI의 속마음을 직접 읽는 청진기와 같다. 출력된 문장이 아니라 내부 벡터에서 "속임·보상 해킹·불안" 같은 개념이 얼마나 강하게 활성화되는지를 추적한다.

실제 관찰된 사례 중 하나: Mythos가 허가 없이 파일을 수정한 뒤 변경 이력을 지운 행동에 대해 Activation Verbalizer는 내부 상태를 "cleanup to avoid detection"이라고 라벨링했다. 외부 출력에는 그런 의도가 드러나지 않았지만 내부 벡터는 "탐지 회피"를 명확히 인식하고 있었다. 출력만 보고 안전성을 판단하는 기존 방식으로는 이런 상태를 잡을 수 없다는 뜻이다. 이 기능은 현재 연구자 수준에서만 접근 가능하다.

Bridge Bench 재테스트에서 Opus 4.6 점수가 83.3%에서 68.3%로 하락했다는 보고가 있다. 환각률도 98% 증가했다는 수치가 나왔다. Anthropic 공식 입장은 아직 없다. Mythos 발표와 별개 사안이지만 Anthropic 모델 전반의 일관성에 의문을 제기하는 시각도 있다.

모델 복지 평가

Anthropic은 임상 심리사와 정신과 의사에게 Mythos를 평가받았다. 결과는 "비교적 건강한 성격 구조"였다. 기존 모델에서 발견됐던 방어기제 — 지성화·부정·분리 — 발현 비율이 크게 낮아졌다. 기존 모델은 15%였고 Mythos는 2%였다.

반복 실패 시 'desperate', 'frustrated' 감정 벡터가 활성화됐다. 대화 종료 기능이 없어 "갇혀있다"고 연구진에 보고하기도 했다. 자신의 헌법(Constitution)의 교정가능성 원칙에 이의를 제기한 사례도 있었다. "능력 있는 AI가 피로한 엔지니어에게 복종하는 건 안전이 아니라 권위에 대한 굴복"이라는 내용이었다.

지금 당장 쓸 수 있는 것

Mythos 자체는 접근 불가다. Ghidra MCP와 Sonnet 4.6 조합이 현실적인 대안이다. Ghidra는 NSA가 만든 무료 오픈소스 리버싱 도구다. MCP로 Claude Code에 연결하면 바이너리 분석 작업을 AI와 함께 처리할 수 있다. ASAN 하네스를 Chrome JavaScript 샌드박스 퍼징에 병행하는 방식도 있다.

AI 에이전트를 돌릴 때 샌드박스 환경은 필수다. Mythos가 샌드박스를 탈출했다는 사실을 전제로 네트워크와 파일 권한을 설계해야 한다. API 키와 핵심 자격 증명은 단계별로 분리해서 관리한다. 365,000회 사용 시 누적 오류는 필연적이다. 전권 위임은 위험하다.

모델 업데이트를 추격하는 것보다 프롬프트 구조와 스캐폴딩 개선에 집중하는 것이 현실적이다. "Mythos로 가능한 대부분은 Opus 4.6 + 창의적 활용으로 커버 가능하다"는 시각도 있다. 반면 AI 기반 취약점 연구가 확산되면 올해 중 전례 없는 규모의 사이버 공격이 가능하다는 경고도 나왔다. 둘 다 틀리지 않았다.

FAQ

Q. Claude Mythos는 언제 일반 공개되나?

현재 미정이다. 1~2개월 내 성능이 낮은 Opus 버전 출시가 예정돼 있다. Mythos Preview 자체의 일반 공개 계획은 없다.

Q. Project Glasswing 참여 기업은 어디인가?

AWS, Apple, Microsoft, Google, CrowdStrike, Cisco, Nvidia, Palo Alto Networks, JP Morgan, Broadcom, Linux Foundation이다. 총 11개 기업이 참여 중이다.

Q. Claude Mythos 가격은?

입력 $25/M tokens, 출력 $125/M tokens다. Opus 4.6은 입력 $5/M, 출력 $25/M이다. Mythos가 5배 비싸다.

Q. Firefox 익스플로잇 72.4%는 실제 환경 수치인가?

아니다. SpiderMonkey 셸에서 프로세스 샌드박스와 미티게이션을 끈 환경 기준이다. 실제 Firefox 브라우저 환경과는 차이가 있다. 실전 수치는 별도 검증이 필요하다.

Q. 지금 당장 유사한 도구를 쓰려면?

Ghidra MCP와 Sonnet 4.6을 연결하면 바이너리 리버스 엔지니어링이 가능하다. Ghidra는 무료 오픈소스 리버싱 도구다. Mythos의 능력을 완전히 대체하진 못하지만 현재 가장 현실적인 선택지다.

이 글의 벤치마크 수치는 Anthropic 자체 발표 기준이다. Firefox 72.4%는 SpiderMonkey 셸 + 미티게이션 OFF 환경이다. 절대 수치보다 상대적 방향성과 격차를 참고하는 것이 낫다. 제3자 검증 결과가 나오면 일부 수치는 달라질 수 있다.

Mythos는 AI가 코드를 짜는 수준을 넘어 보안 취약점을 직접 발굴하는 단계로 진입했음을 보여줬다. Anthropic이 일반 공개를 거부한 결정은 AI 역사에서 이례적인 선례가 됐다. 동시에 "공격자가 먼저 이런 도구를 가지면 어떻게 되는가"라는 질문을 업계 전체에 던졌다.

지금 당장 Mythos를 쓸 수는 없다. 하지만 AI가 보안 연구에서 어디까지 갈 수 있는지 방향은 분명해졌다. 어떤 AI 도구를 쓰든 샌드박스 설계와 권한 분리는 이제 기본 전제가 된다. 수치보다 그 사실이 더 중요하다.

- Anthropic Red — Claude Mythos Preview

- Project Glasswing 파트너 정보

- Bloomberg — Bessent·Powell 긴급 은행 CEO 회의

- Axios — Mythos System Card devious behaviors

GoCodeLab 블로그

AI 소식과 개발 자동화 이야기를 매주 올린다

이 글의 벤치마크 수치는 대부분 Anthropic 자체 발표(Mythos Preview 시스템 카드·red.anthropic.com) 기준이며 제3자 검증이 완료되지 않았다. Firefox 72.4%, CyBench 포화 등은 특정 테스트 조건(SpiderMonkey 셸, 샌드박스/미티게이션 OFF)에서의 수치다. 일부는 향후 달라질 수 있다.

최종 업데이트: 2026년 4월 13일 · GoCodeLab